Entwurfsprioritäten, Beschränkungen und Bereitschaft

Zusammenfassung

- KI-Rechenzentren sind nicht einfach herkömmliche Einrichtungen mit mehr Servern. Sie stellen wesentlich höhere Anforderungen an die Stromversorgung, die Wärmeableitung, die Netzwerkstruktur, die Steuerung und die schrittweise Erweiterungsplanung.

- Die ersten Engpässe treten oft außerhalb der Serverhalle auf: Verfügbarkeit der Stromversorgung, Qualität der Stromleitungen, Kühltopologie, Kapazität der mechanischen Anlagen und die Fähigkeit, die Anlage zu skalieren, ohne die Ausfallsicherheit zu beeinträchtigen.

- Die Flüssigkeitskühlung wird für Umgebungen mit höherer Dichte immer wichtiger, aber sie ist keine alleinige Lösung. Sie wirkt sich auf die Anlagenkonstruktion, die Hydraulikstrategie, die Steuerung, die Wartungsfreundlichkeit und die Architektur der Wärmeabfuhr aus.

- Die Eignung von KI sollte durch technische Analysen validiert werden und nicht nur anhand des Platzbedarfs im Rack angenommen werden. Thermische Modellierung, elektrische Studien, Netzbewertung, Koordinierungsprüfung und gestaffelte Kapazitätsanalyse sind für eine glaubwürdige Entscheidung von zentraler Bedeutung.

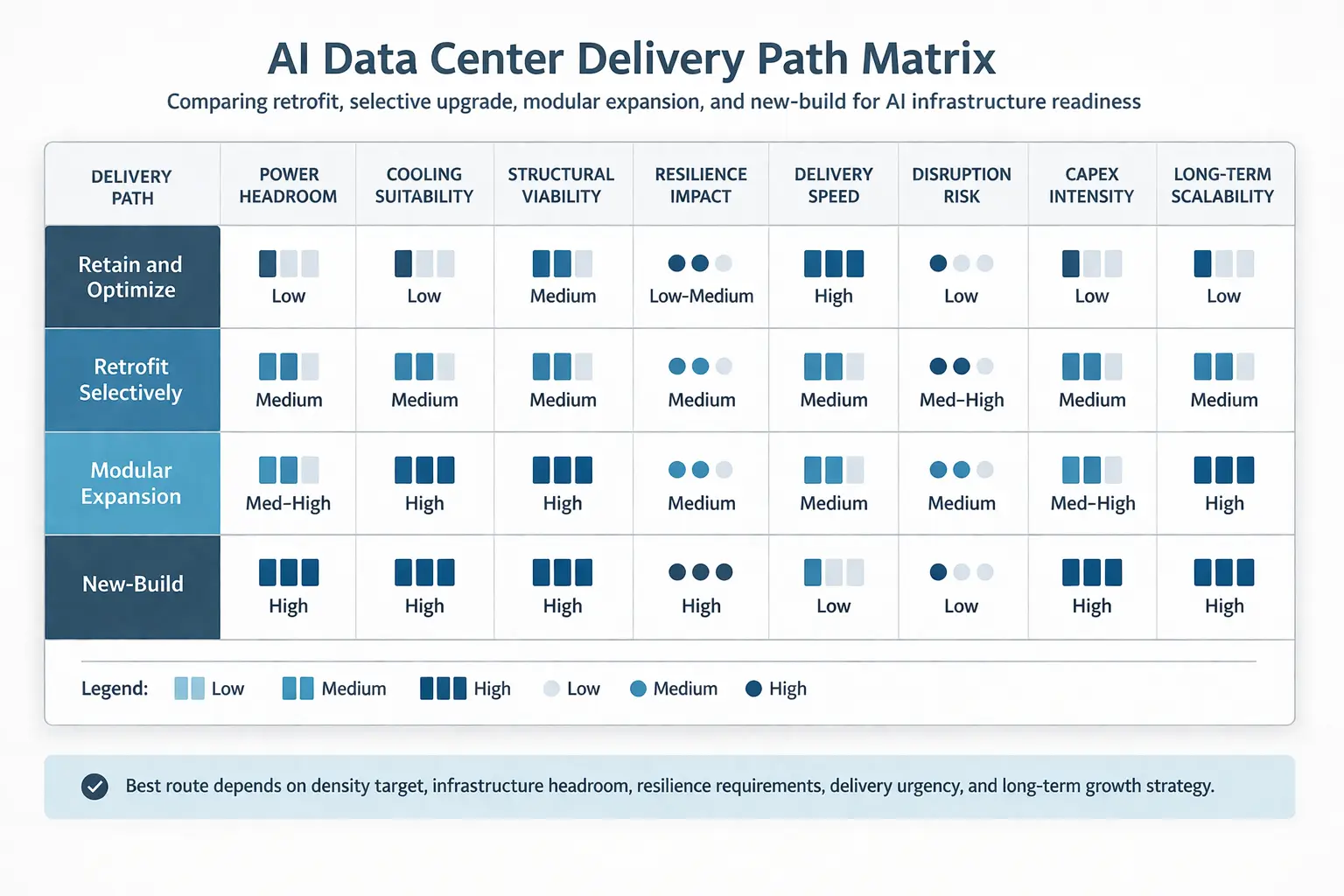

- Bei vielen Projekten ist die eigentliche Entscheidung nicht nur, ob ein Standort “KI-tauglich” ist, sondern ob Nachrüstung, selektive Aufrüstung, modulare Erweiterung oder Neubau der vertretbarste Weg ist.

- Für Eigentümer, Betreiber, Entwickler und Investoren ist die Qualität des Front-End-Engineerings und der technischen Due-Diligence-Prüfung oft ausschlaggebend dafür, ob ein KI-Rechenzentrumsprojekt baubar, finanzierbar und betrieblich stabil bleibt.

- Die zentrale Herausforderung für Rechenzentren besteht darin, die ständig steigende Nachfrage nach Rechenleistung und Speicherplatz für KI-Anwendungen zu befriedigen. KI-Workloads erfordern enorme Mengen an Rechenleistung, die oft Exascale-Niveau erreichen, um komplexe Modelle und Algorithmen zu verarbeiten. Dieser exponentielle Anstieg der Nachfrage nach Rechenressourcen und Speicherkapazitäten treibt erhebliche Veränderungen und Innovationen in der Rechenzentrumsbranche voran.

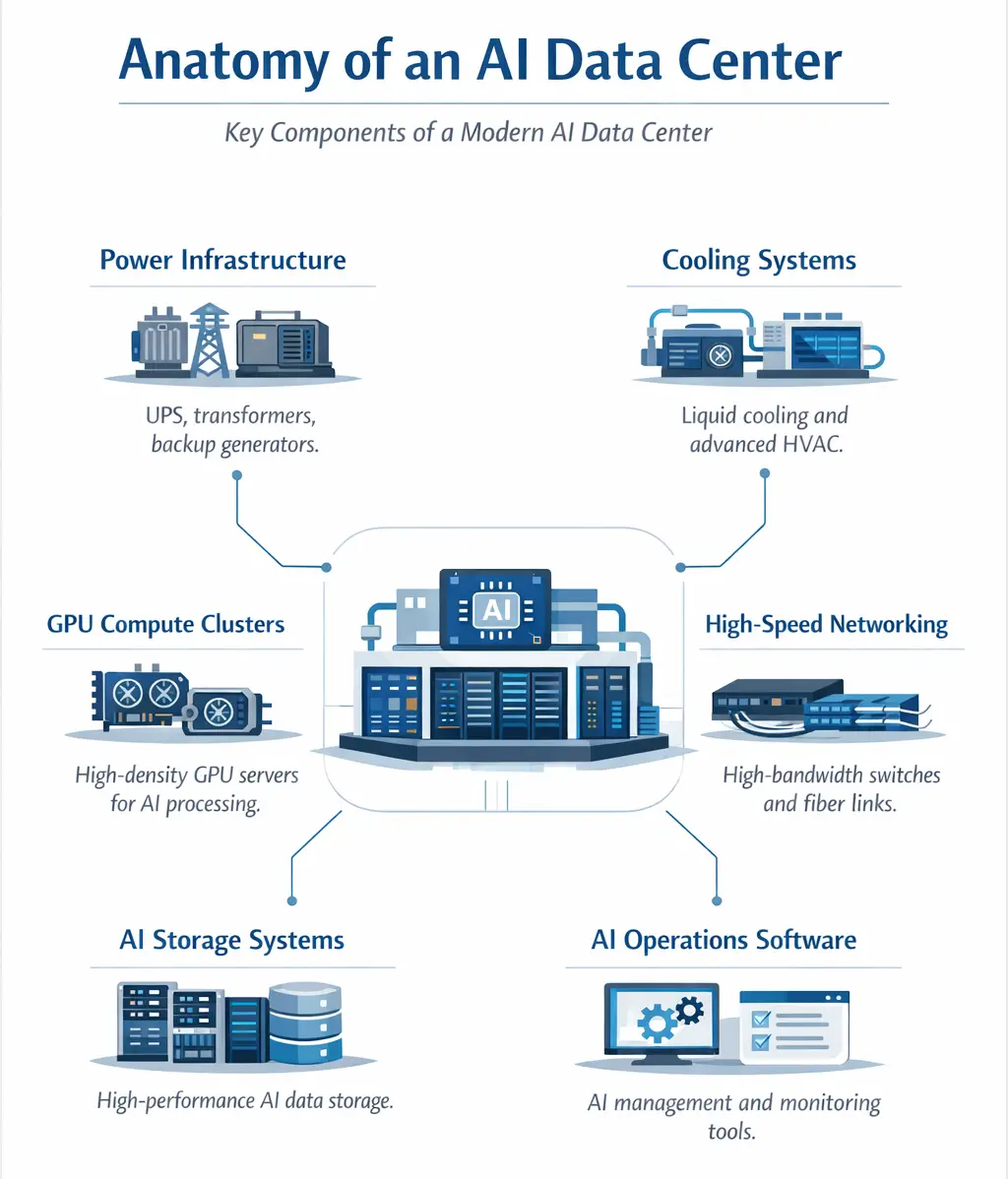

KI-Workloads verändern die Anforderungen an Rechenzentren nicht nur auf IT-Ebene, sondern auch auf der Ebene der Infrastruktur. Dichte GPU-Umgebungen, beschleunigte Berechnungen, Verbindungen mit geringer Latenz und anhaltende Trainings- oder Inferenzlasten zwingen zu einem Überdenken der Stromversorgungsarchitektur, der Kühlungsstrategie, der Steuerungssysteme und der Erweiterungslogik.

Für technische und kaufmännische Entscheidungsträger geht die Diskussion über die Frage hinaus, wie viele Racks ein Gebäude physisch aufnehmen kann. Vielmehr geht es um die Frage, ob die Anlage eine höhere Dichte aufnehmen kann, ob die Versorgungs- und Maschinensysteme den beabsichtigten Wachstumspfad unterstützen können, ob das Belastbarkeitsmodell auch unter neuen Betriebsbedingungen Bestand hat und ob der gewählte Weg im Rahmen der örtlichen Vorschriften und Infrastrukturen tragfähig ist.

Dieser Artikel richtet sich an Leser, die die KI-Infrastruktur aus der Perspektive einer Einrichtung, eines Projekts oder einer Investition bewerten. Er konzentriert sich nicht auf die Chipauswahl oder die Modellarchitektur. Er konzentriert sich darauf, was KI für die physische und betriebliche Infrastruktur bedeutet, die diese Arbeitslasten unterstützen muss.

Er ist aus der Perspektive der technischen Machbarkeit, des Infrastrukturrisikos und der praktischen Umsetzbarkeit geschrieben und spiegelt den Kontext der Azuras Rechenzentrumsentwurf, Die Infrastrukturkapazitäten, die technische Due-Diligence-Prüfung und die multidisziplinären Ingenieursdienstleistungen sind auf die verschiedenen Ebenen ausgerichtet.

Was ist also ein KI-Rechenzentrum?

Ein KI-Rechenzentrum ist ein Rechenzentrum, das für die Unterstützung von KI-Workloads mit hoher Dichte konzipiert oder angepasst wurde. Dazu gehören in der Regel beschleunigte Berechnungen, Netzwerke mit hoher Bandbreite und anspruchsvollere Energie- und Wärmebedingungen als bei herkömmlichen Rechenumgebungen in Unternehmen.

In der Praxis wird sie weniger durch das Vorhandensein von GPUs allein definiert, sondern vielmehr dadurch, ob die elektrische, mechanische, Netzwerk-, Steuerungs- und Ausfallsicherheitsarchitektur diese Arbeitslasten sicher, effizient und in großem Umfang unterstützen kann.

Auf einen Blick

- Das optimale Design hängt vom Workload-Profil, der angestrebten Dichte, den Anforderungen an die Ausfallsicherheit und dem Nutzungskontext ab.

- Energie- und Kühlungsbeschränkungen bestimmen in der Regel die Auslieferungsstrategie vor der Weißraumkapazität.

- Eine Nachrüstung ist manchmal möglich, aber nur, wenn tatsächlich bauliche, elektrische und mechanische Möglichkeiten vorhanden sind.

- Durch die Flüssigkeitskühlung lassen sich zwar höhere Dichten erreichen, aber sie bringt auch Auswirkungen auf die Anlagen, die Steuerung und die Wartung mit sich.

- KI-Readiness ist eine Systemfrage, keine Funktionsliste.

- Azura Consultancy bietet unter anderem Machbarkeitsstudien, Standortauswahl, kritische MEP-Designs, CFD-Analysen, Analysen elektrischer Energiesysteme, Zuverlässigkeitsstudien, BIM-Koordination, Zertifizierungsunterstützung, Netzwerkinfrastrukturdesign und technische Due Diligence.

Was ein KI-Rechenzentrum auszeichnet

Ein herkömmliches Rechenzentrum kann sehr zuverlässig sein und sich dennoch schlecht für den Einsatz von KI eignen. Das Problem ist nicht nur der Servertyp. KI-Arbeitslasten verändern das Verhältnis zwischen Rechendichte, Netzwerkdurchsatz, Kühlungsreaktion, Stromversorgung auf Rack-Ebene und zukünftiger Erweiterungsplanung.

Das ändert das technische Problem. Das Anlagenteam plant nicht mehr in erster Linie für die gesamte IT-Last. Es plant für eine lokal begrenzte Dichte, eine nachhaltige Wärmeabfuhr, einen anspruchsvolleren Ost-West-Verkehr, engere Kontrollspannen und eine geringere Toleranz für Schwächen der Teilsysteme.

In der Praxis legen KI-Rechenzentren in der Regel mehr Wert auf:

- höhere Wärmebelastung der Regale und Reihen

- geringere Toleranz gegenüber Engpässen im Netz

- eine kritischere Planung der Stromqualität und der Verteilung

- engere Integration zwischen Gebäudetechnik und IT-Einsatz

- eine detailliertere Logik für die Phaseneinteilung des Wachstums

Aus diesem Grund reicht eine allgemeine “KI-fähige” Positionierung oft nicht aus. Eine Einrichtung braucht nachweisbare Kapazitäten, validierte Annahmen und einen glaubwürdigen Upgrade-Pfad.

Die Beschränkungen, die in der Regel zuerst auftauchen

Bei den meisten KI-Rechenzentrumsprojekten ist der erste begrenzende Faktor nicht der Platzbedarf. Es sind eine oder mehrere vorgelagerte Einschränkungen, die darüber entscheiden, ob der Einsatz einer höheren Dichte technisch und kommerziell machbar ist.

Diese Einschränkungen treten oft frühzeitig auf, weil die KI-Infrastruktur die Lastkonzentration verstärkt. Ein Standort kann in Bezug auf die allgemeine Kapazität attraktiv erscheinen, aber bei näherer Betrachtung dennoch scheitern, wenn das Timing der Stromversorgung, die Kühltopologie oder die Annahmen zur Ausfallsicherheit nicht mit dem geplanten Einsatz übereinstimmen.

Die gebräuchlichsten Bereiche, in denen es zu Einschränkungen kommt, sind:

- Netzzugang und Stromtaktung: Der Standort kann grundsätzlich vielversprechend sein, aber kommerziell unbrauchbar, wenn die Versorgungsleistungen nicht mit dem Errichtungsplan übereinstimmen.

- Mechanische Bauhöhe: Kaltwasser-, Kondensatorwasser-, Trockenkühl- oder Hybridanlagen können die angestrebte Dichte nicht ohne größere Umgestaltung erreichen

- Auswirkungen auf die Resilienz: Die Erhöhung der Dichte kann das beabsichtigte Fehlertoleranz- oder Wartbarkeitsmodell schwächen, wenn die elektrischen und mechanischen Pfade nicht revalidiert werden.

- Wasser- und Wärmeableitung: Das Klima, die örtlichen Wasserverhältnisse und die Strategie zur Wärmeabfuhr können dazu führen, dass eine Kühlarchitektur besser geeignet ist als eine andere.

- Netzwerktopologie: KI-Umgebungen legen großen Wert auf Konnektivität mit niedriger Latenz und hoher Bandbreite innerhalb der Einrichtung und in einigen Fällen auch über Standorte oder externe Verbindungen hinweg.

- Genehmigungen und Nachhaltigkeitserwartungen: Diese können das Lieferrisiko, die Akzeptanz durch die Interessengruppen und die Betriebseinschränkungen erheblich beeinflussen.

Für viele Eigentümer und Investoren ist dies der Punkt, an dem das Gespräch eher kommerziell als konzeptionell wird. Ein technisch mögliches Vorhaben kann immer noch unattraktiv sein, wenn der Upgrade-Pfad zu langsam, zu störend oder zu unsicher ist. Technische Due Diligence für Investoren ist häufig erforderlich, bevor größere Verpflichtungen eingegangen werden.

Die Kühlungsstrategie prägt jetzt die Einrichtung, nicht nur den Weißraum

Die immer dichter werdende KI-Infrastruktur ist ein Grund dafür, dass die Flüssigkeitskühlung nicht mehr nur von Spezialisten diskutiert wird, sondern in den Mainstream der Rechenzentrumsplanung übergegangen ist. Das bedeutet nicht, dass jede KI-Implementierung dieselbe Kühllösung erfordert, aber es bedeutet, dass die Kühlstrategie jetzt direkte Auswirkungen auf die Gebäudetechnik, die Anlagenarchitektur, die Steuerung, die Wartung und die künftige Erweiterung hat.

Zu den Fragen, die frühzeitig geklärt werden müssen, gehören:

- angestrebte Rackdichte und erwartete Zunahme der Dichte

- zulässiger Betriebsbereich und Temperaturbereich

- Wahlmöglichkeit zwischen Luft-, Flüssigkeits- oder Hybridkühlung

- CDU-Strategie, hydraulische Anordnung und Leckmanagement-Philosophie

- Anlagenredundanz und Isolierung der Wartung

- Wärmeabfuhrweg und klimatische Eignung

- ob sich die Wärmerückgewinnung technisch und kommerziell lohnt

Hier kommt es auf die technische Validierung an. Ein Schema, das auf dem Papier akzeptabel aussieht, kann dennoch instabil oder ineffizient werden, wenn die Dichte zunimmt, die Ausrüstung verlegt wird oder sich die Betriebsbedingungen ändern. Die thermische Analyse ist daher nicht nur eine Designaufgabe. Sie ist ein Werkzeug zur Entscheidungshilfe.

Kühlungsentscheidungen in KI-Umgebungen sollten validiert und nicht vorausgesetzt werden. Azuras spezielle Engineering-Fähigkeiten umfassen CFD-Analysen für den Weißraum von Rechenzentren, Kühl- und Heizlastberechnungen, Energiemodellierung und damit verbundene mechanische und hydraulische Analysen. Dies ist die Art von Arbeit, die erforderlich ist, wenn Dichte, Luftstromstabilität, Flüssigkühlungsschnittstellen und langfristige Betriebseffizienz alle zu Designeinschränkungen werden.

Die öffentlichen Zertifizierungen von Azura umfassen gegebenenfalls auch ASHRAE-Zertifikate und LEED AP, die die Glaubwürdigkeit der Arbeit an der Schnittstelle zwischen thermischer Leistung, Gebäudesystemen und energiebewusstem Infrastrukturdesign und Gesamtkonzept stärken. Nachhaltigkeit von Rechenzentren.

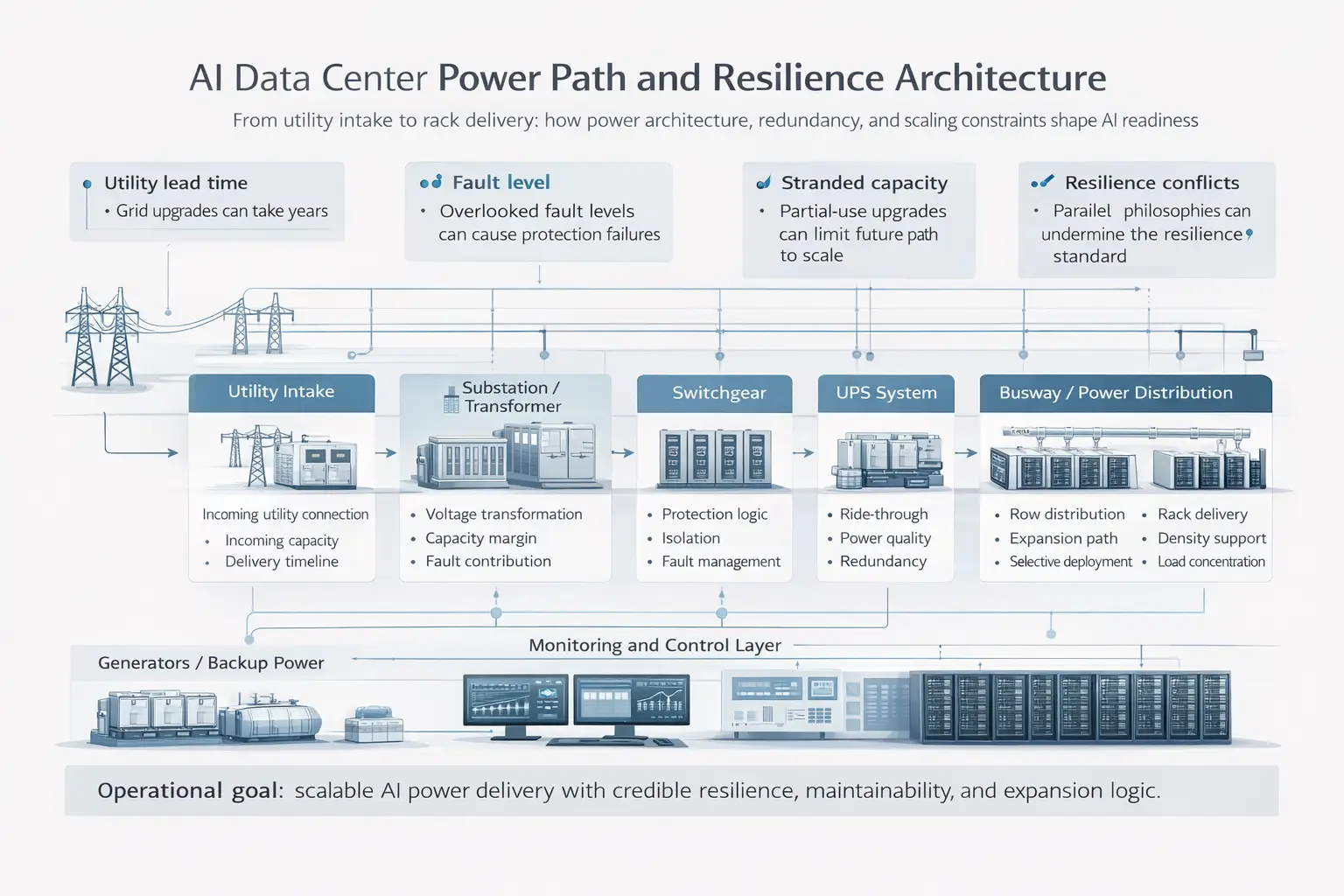

Stromversorgungsarchitektur und Ausfallsicherheit bestimmen, ob die Skalierung real ist

KI-Einsätze setzen die Glaubwürdigkeit des elektrischen Designs unter ungewöhnlichen Druck. Ein System kann auf dem Papier skalierbar erscheinen, aber dennoch keine vertretbare Betriebsroute bieten, wenn Transformatorenkapazität, USV-Architektur, Sammelschienenstrategie, Generatorphilosophie, Fehlerpegel, Oberschwingungen, Schutzkoordination oder Wartungsannahmen nicht ordnungsgemäß getestet wurden.

Die Frage ist nicht nur, wie viele Megawatt gesichert werden können. Es geht auch darum, ob der elektrische Pfad von der Stromzufuhr bis zur Bereitstellung auf Rack-Ebene die geplante Dichte mit akzeptabler Belastbarkeit, Wartungsfreundlichkeit und Fehlerisolierung unterstützen kann.

Zu den Fragen, die vor der Skalierung beantwortet werden sollten, gehören:

- Kann der vorgesehene Stromversorgungspfad die angestrebte KI-Dichte unter dem geforderten Belastungsmodell unterstützen?

- Gelten die Annahmen zu Kurzschluss und Schutz nach der Erweiterung noch?

- Sind die Annahmen zu Generator, Kraftstoff und Laufzeit bei dem höheren Lastprofil noch glaubwürdig?

- Ist die USV-Topologie für das Betriebsmodell und das Wartungsregime geeignet?

- Entstehen durch die stufenweise Einführung Kapazitätsengpässe oder wiederholte Nacharbeiten?

- Wird die Energiespeicherung nur als Backup oder auch für das Lastmanagement und die Netzstrategie bewertet?

Dies ist ein Grund Zertifizierung von Rechenzentren und Klassifizierungsrahmen bleiben relevant. Sie ersetzen nicht das technische Urteilsvermögen, aber sie helfen, es zu strukturieren.

Für KI-Einrichtungen müssen die Annahmen zur Ausfallsicherheit mehr als nur theoretisch sein. Azuras Engineering-Angebot für Rechenzentren umfasst explizit die Unterstützung bei der Uptime-Tier-Zertifizierung, Tier-III- und Tier-IV-konformes Design, Notstrom- und Redundanzplanung, Analyse des elektrischen Energiesystems sowie Zuverlässigkeits- und Verfügbarkeitsanalysen.

Das ist wichtig, weil AI-Umgebungen mit hoher Dichte die Folgen schwacher Annahmen bei der Versorgungsstrategie, USV-Topologie, Generatorphilosophie, Oberschwingungen, Kurzschlusskoordination und stufenweiser Erweiterungsplanung verstärken. Die öffentliche Zertifizierungsseite von Azura enthält auch Uptime ATD- und ATD-Experten-Zertifikate, die für die Disziplin des Designs und der Überprüfung von Tier-orientierten Rechenzentren direkt relevant sind.

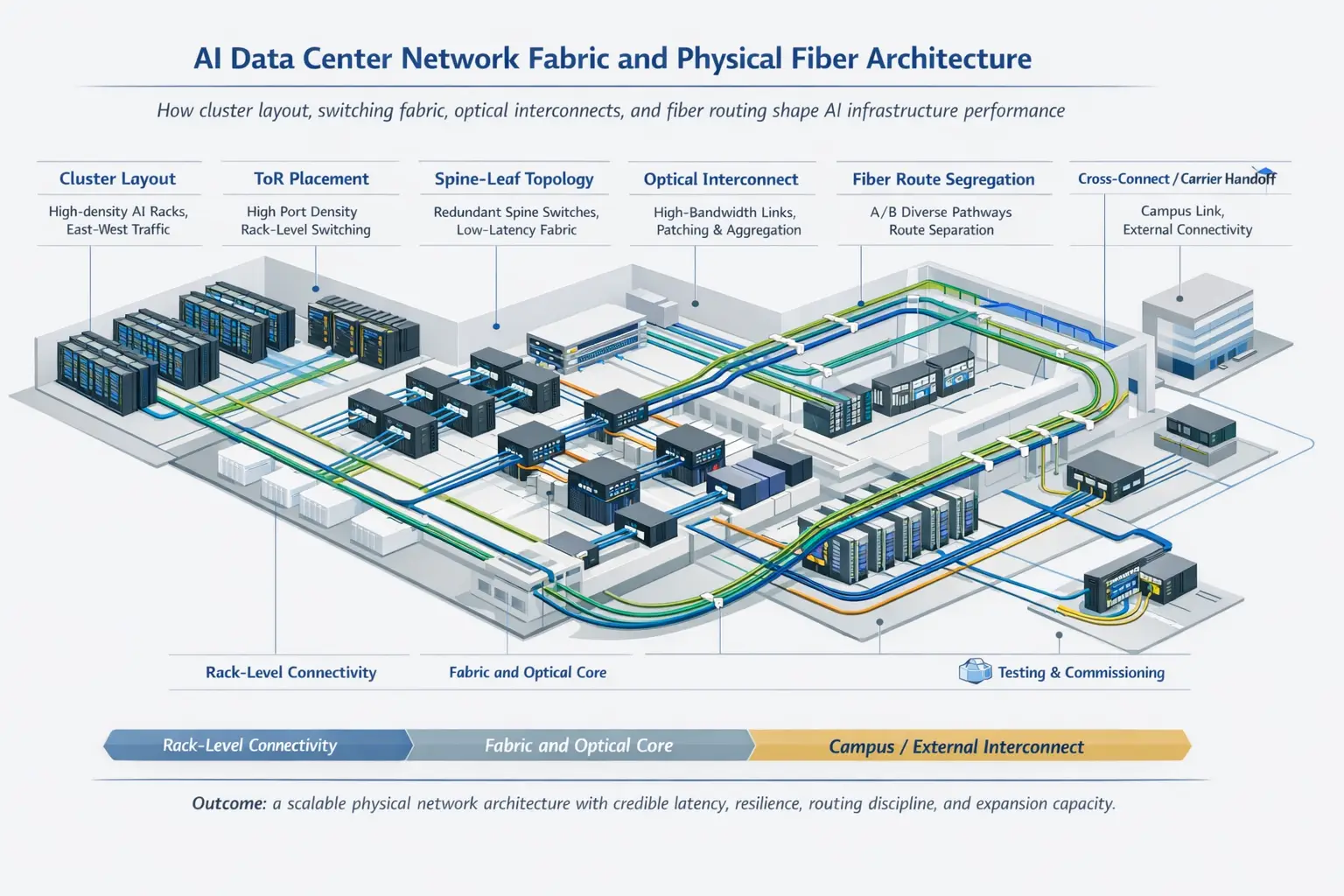

Die Netzgestaltung ist Teil des Problems der physischen Infrastruktur

KI-Rechenzentren sind nicht nur auf leistungsstarke Rechenleistung angewiesen, sondern auch auf eine schnelle, vorhersehbare Datenübertragung zwischen den Systemen. Das macht das Netzwerkdesign zu einem zentralen Leistungsthema und nicht zu einem sekundären Nutzen.

In vielen KI-Umgebungen wirken sich Ost-West-Verkehrsmuster direkt auf die Effizienz von Workloads, Trainingszeiten und die Clusterauslastung aus. Eine Einrichtung, die für herkömmliches Unternehmenshosting geeignet ist, kann für KI-Workloads dennoch Probleme verursachen, wenn die Kabelwege, die Switch-Platzierung, die Portdichte, die Ausfallsicherheit der Pfade oder die Erweiterungslogik schwach sind.

Hier spielen auch die physikalische Telekommunikation und das Glasfaserdesign eine größere Rolle, als viele Laien annehmen. Die Leistung des Netzes hängt nicht nur von den Switch-Spezifikationen ab. Sie hängt auch von der Routenplanung, der Kabelarchitektur, der Auswahl der Glasfasern, der Qualität der Spleiße, der DWDM-Planung (sofern relevant), den Tests und der Disziplin bei der Inbetriebnahme ab.

In der Praxis sollte die Bereitschaft des Netzes berücksichtigt werden:

- Kapazität der internen Glasfaser- und Kupferleitungen

- physische Routenplanung und Abtrennung für Resilienz

- Switch- und Fabric-Platzierung im Verhältnis zum Cluster-Layout

- Anschlussdichte und Auswirkungen auf das Kabelmanagement

- zukünftige Expansionspfade ohne Fragmentierung

- DWDM- oder Campus-/Interconnect-Entwürfe, die für mehrere Gebäude oder Langstreckenverbindungen relevant sind

- Prüfung und Inbetriebnahme zur Validierung der tatsächlichen Leistung vor der Inbetriebnahme

Dies ist ein Bereich, in dem Azuras Entwurfsdienstleistungen für Telekommunikationsnetze Dies ist besonders wichtig, da die KI-Leistung ebenso leicht durch eine schwache physische Netzarchitektur wie durch ein schwaches Stromversorgungs- oder Kühlungsdesign beeinträchtigt werden kann.

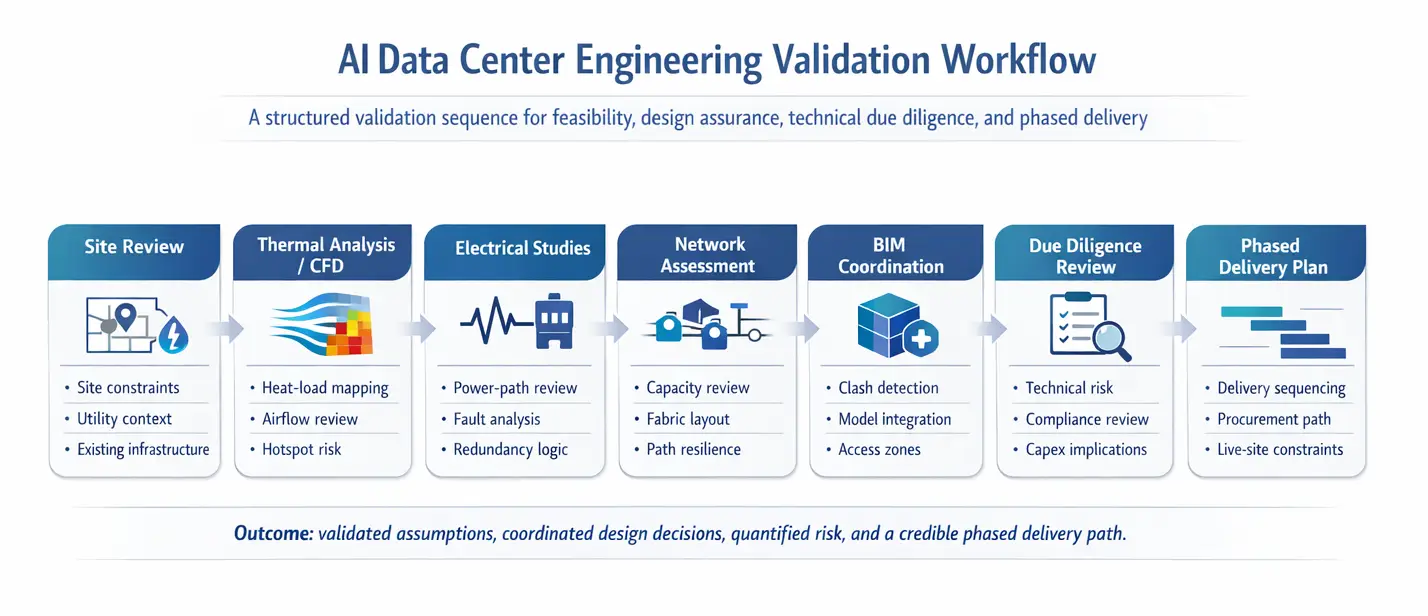

Wie die Bereitschaft von AI-Rechenzentren in der Praxis validiert wird

Eine KI-Rechenzentrumsstrategie ist technisch nicht glaubwürdig, wenn sie sich auf die Beschreibung von Funktionen beschränkt. Die Bereitschaft muss durch eine strukturierte technische Analyse getestet werden.

Der genaue Umfang hängt von der Art des Projekts ab, aber das Ziel ist einheitlich: Überprüfung der tatsächlichen Einschränkungen, Quantifizierung der Auswirkungen der Modernisierung und Trennung der Nennkapazität von der nutzbaren Kapazität.

Ein praktischer Validierungsprozess umfasst in der Regel vier Ebenen.

Thermische und mechanische Validierung

Dies beinhaltet in der Regel eine Überprüfung der Wärmelastverteilung, der Luftstrom- oder Flüssigkeitskühlungsstrategie, der Einschlusslogik, der Anlagenkapazität und der Auswirkungen künftiger Dichteänderungen auf die thermische Hülle.

Typische Ausgaben sind:

- Hotspot-Identifizierung

- Abbildung von Kühlungsengpässen

- Grenzwerte für die Anlagenkapazität

- Schwellenwerte für die Dichte nach Zonen oder Hallen

- Auswirkungen auf Energieeffizienz und Kontrollierbarkeit

Elektrische Validierung

Dazu gehören die Überprüfung der Strompfade, die Modellierung des Lastwachstums, die Überprüfung der Redundanz, Schutz- und Koordinierungsstudien, gegebenenfalls die Überprüfung von Oberschwingungen und der Energiequalität sowie die Analyse des stufenweisen Ausbaus.

Typische Ausgaben sind:

- geprüfte elektrische Bauhöhe

- einzelne Schwachstellen identifiziert

- Auslöser

- Auswirkungen auf der Fehlerebene

- Anforderungen an die Upgrade-Reihenfolge

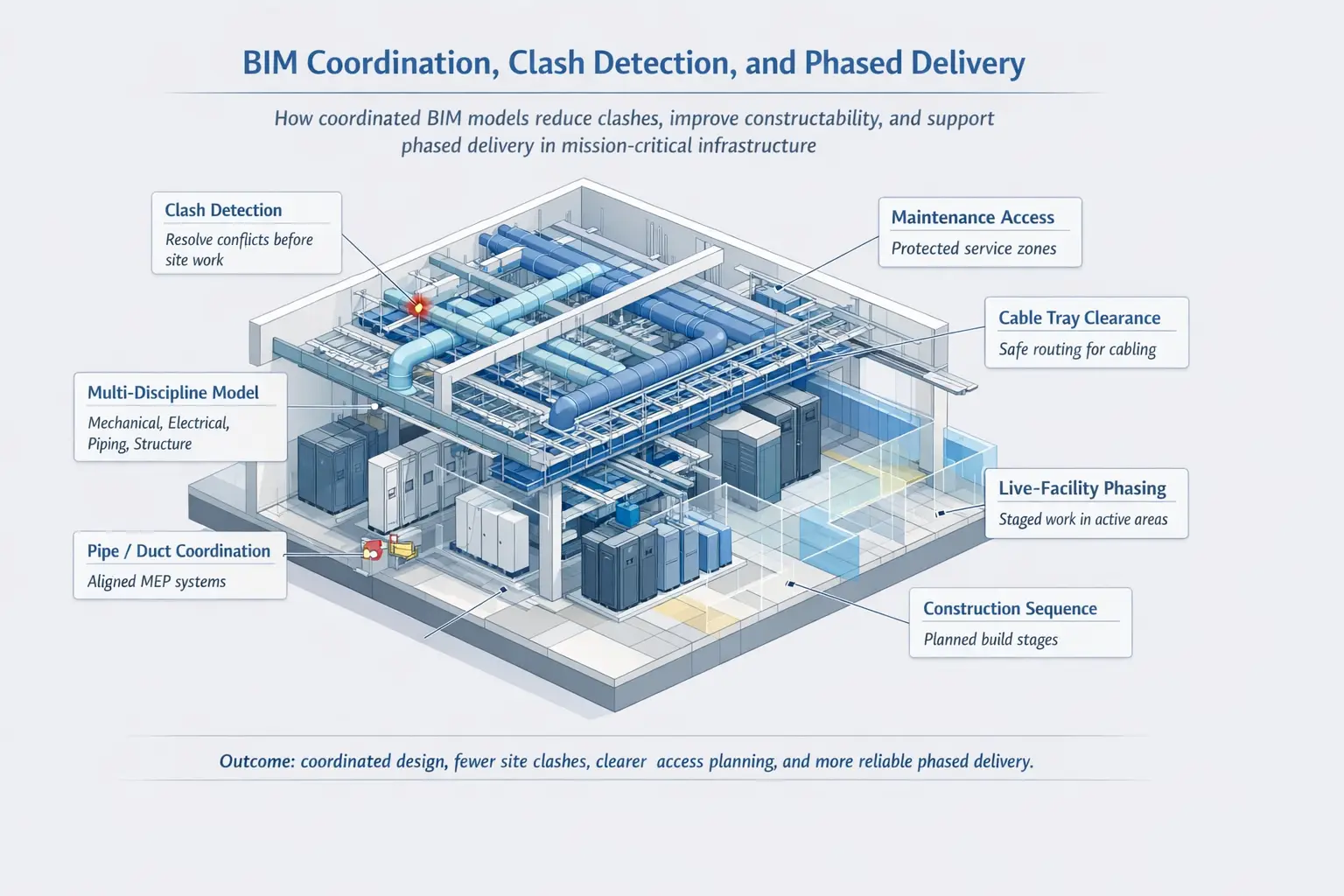

Koordinierung der Einrichtungen und Validierung der Lieferung

Bei Nachrüstungs- und Schnellbauprogrammen kann das Koordinationsrisiko ebenso wichtig sein wie die reine Angemessenheit der Planung. BIM-geführte Koordinierung, Kollisionsprüfung und Überprüfung der Bauphasen helfen dabei, festzustellen, ob Upgrades in einer realen Umgebung tatsächlich realisierbar sind.

Typische Ausgaben sind:

- Konflikt- und Zugangsprobleme frühzeitig erkannt

- klarere Abfolge der Installation

- reduziertes Nacharbeitsrisiko

- realistischere Annahmen für Ausfälle und Phasenwechsel

- bessere Abstimmung zwischen den Disziplinen

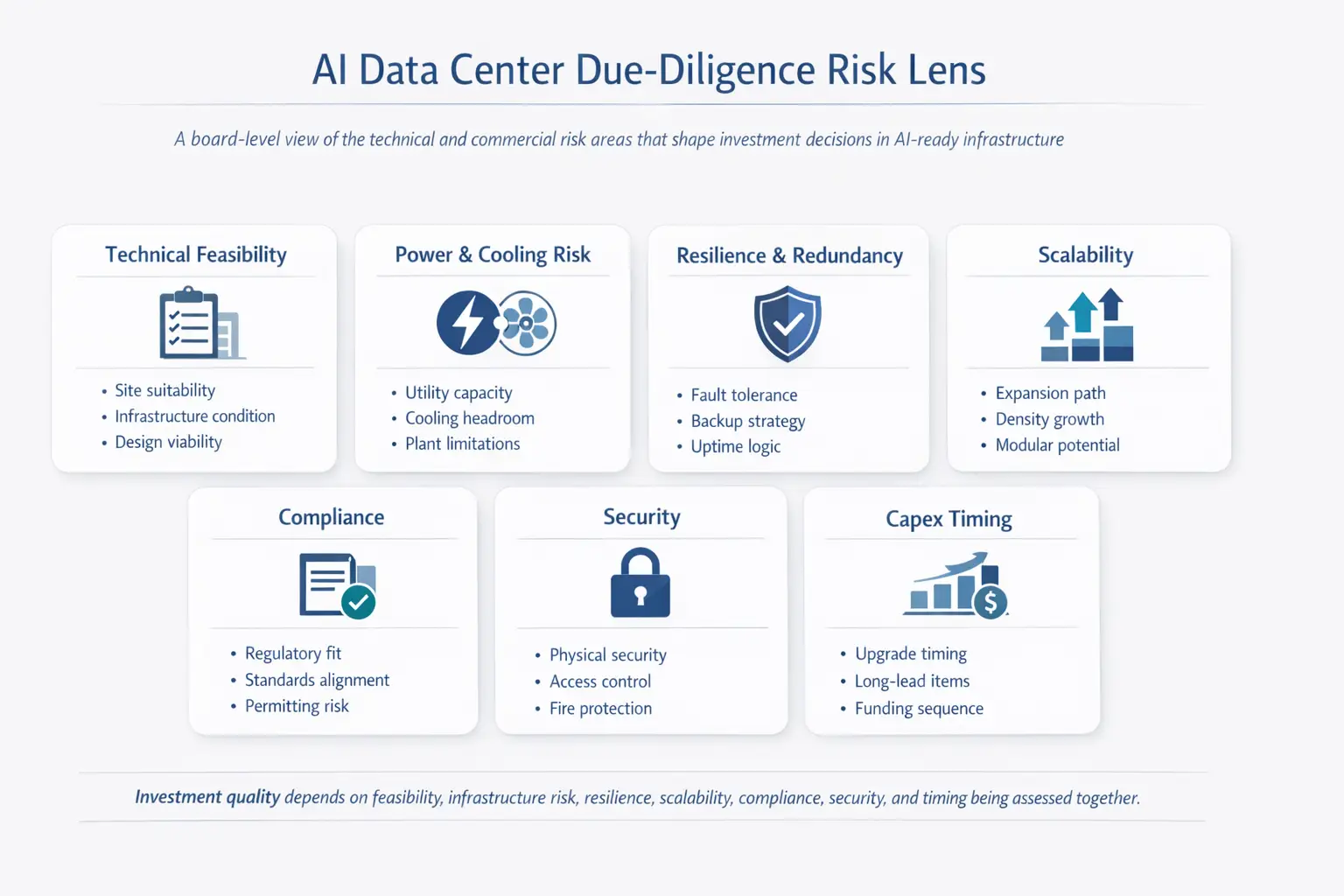

Due-Diligence-Prüfung

Investoren, Kreditgeber, Käufer und Betreiber, die eine Anlage übernehmen, sollten bei der Überprüfung der Bereitschaft nicht nur die derzeitige Infrastruktur bewerten, sondern auch die Durchführbarkeit, das Risiko, die Widerstandsfähigkeit, die Skalierbarkeit, die Einhaltung der Vorschriften und die praktischen Kosten für die Schließung der Bereitschaftslücke.

Typische Ausgaben sind:

- geprüfte Kapazität anstelle der Nennkapazität

- quantifiziertes Nachrüstungsrisiko

- klarere Investitionslogik

- definierte Upgrade-Engpässe

- eine glaubwürdigere Entscheidungshilfe für Nachrüstungen im Vergleich zu Neubauten

In dieser Validierungsphase wird die Qualität der Beratung sichtbar. Azuras dokumentierter Ansatz kombiniert die Überprüfung des Standorts, die Überprüfung der technischen Dokumentation, die CFD-geführte thermische Analyse, die Analyse des elektrischen Energiesystems und, falls erforderlich, die Analyse der Stromversorgungssysteme, Modellierung von Gebäudedaten (BIM)-basierte Koordination und technische Due Diligence.

Die BIM-Fähigkeiten umfassen auch LOD300- bis LOD500-Modelle, Kollisionserkennung und 4D- / 5D- / 6D-Integration, die besonders dann von Bedeutung sind, wenn Nachrüstungsarbeiten, die Phaseneinteilung auf der Baustelle oder multidisziplinäre Koordinationsrisiken die Lieferung gefährden könnten.

Normen, Zertifizierung und Berichterstattung: Was jeder Einzelne tut

Das Design von KI-Rechenzentren profitiert von Standards und Frameworks, aber sie erfüllen unterschiedliche Aufgaben und sollten nicht als austauschbar betrachtet werden.

Eine klarere Art, sie zu verwenden, ist die folgende:

- ISO/IEC 22237 hilft dabei, den breiteren Ansatz für die Planung von Einrichtungen und Infrastrukturen, einschließlich der Verfügbarkeit, der physischen Sicherheit und der Energieeffizienz, festzulegen

- ASHRAE-Leitfaden für den Wärmeschutz unterstützt die Annahmen für die thermische Hülle, die Kühlung und die Umweltbedingungen

- Uptime Tier Strategie und Zertifizierung bei der Definition der Ausfallsicherheit und der Erwartungen an die Topologie der Infrastruktur helfen

- Regionalpolitik und Meldevorschriften die Einhaltung von Vorschriften, die Offenlegung von Nachhaltigkeitsdaten und manchmal auch Designprioritäten beeinflussen

Der praktische Punkt ist einfach: Standards und Berichterstattungsregeln gestalten die Einrichtung nicht für Sie, aber sie bestimmen, wie Bereitschaft, Widerstandsfähigkeit, Leistung und Rechenschaftspflicht zu bewerten sind.

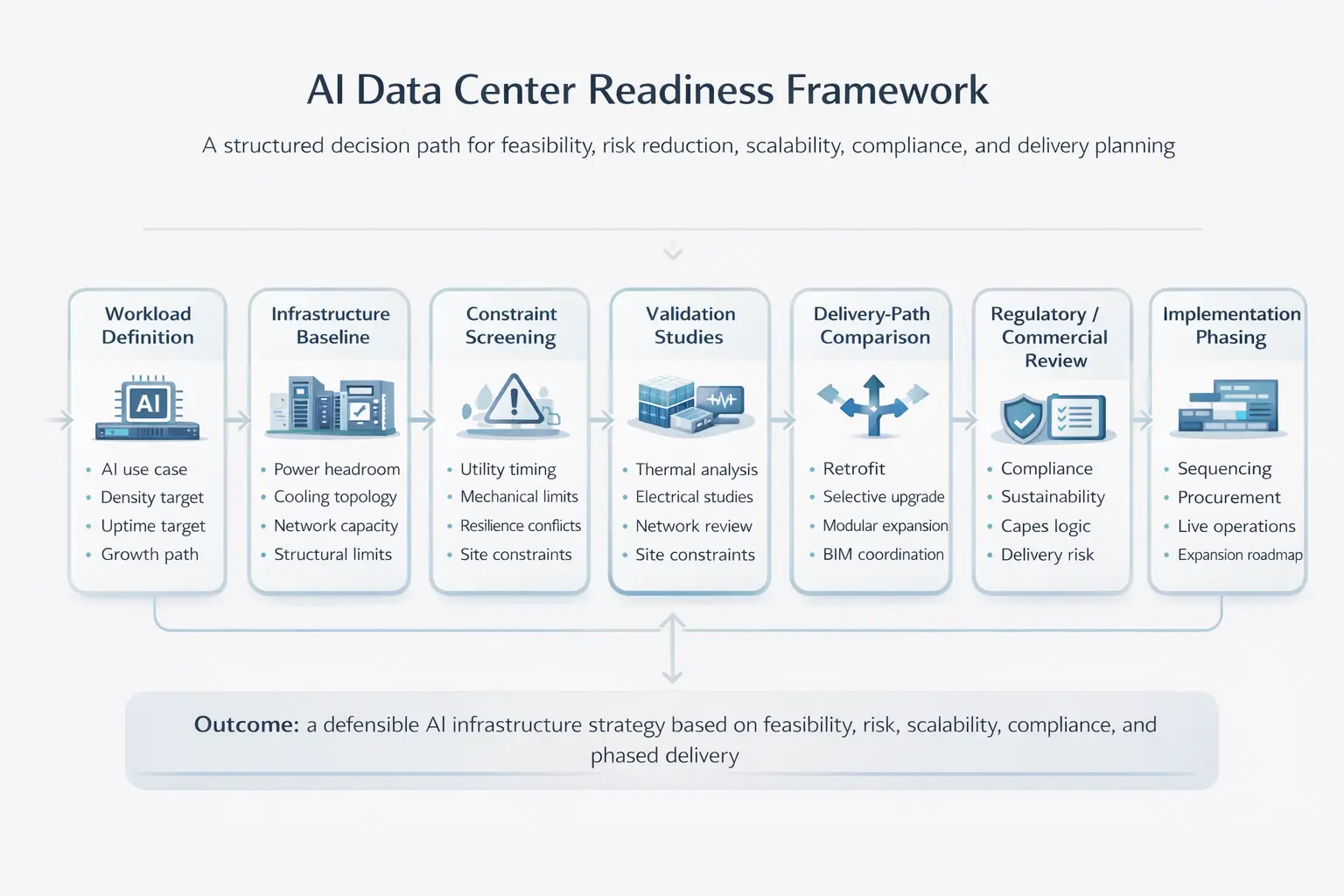

AI Data Center Readiness Framework für Eigentümer, Betreiber und Investoren

Der sinnvollste Weg, ein KI-Rechenzentrum zu bewerten, besteht darin, es als ein Bereitschaftsproblem über verknüpfte Bereiche hinweg zu behandeln und nicht als eine einzelne Ja-oder-Nein-Frage.

Der sinnvollste Weg, ein KI-Rechenzentrum zu bewerten, besteht darin, es als ein Bereitschaftsproblem über verknüpfte Bereiche hinweg zu behandeln und nicht als eine einzelne Ja-oder-Nein-Frage.

Ein praktischer Bereitschaftsrahmen sieht in der Regel wie folgt aus:

- Definition der Arbeitsbelastung - Definieren Sie den wahrscheinlichen KI-Nutzungsfall, den Dichtebereich, das Betriebszeitziel, das Netzwerkverhalten und den Wachstumspfad.

- Grundlegende Infrastruktur Ermitteln Sie den tatsächlichen elektrischen, mechanischen, strukturellen, steuerungs- und netztechnischen Spielraum.

- Constraint Screening - Identifizieren Sie Hindernisse erster Ordnung, wie z. B. die Vorlaufzeit der Versorgungsunternehmen, die Unausgewogenheit der Kühlung, strukturelle Beschränkungen oder Konflikte in Bezug auf die Belastbarkeit.

- Validierungsstudien - Führen Sie die technische Analyse durch, die zur Bestätigung oder Ablehnung des Konzepts erforderlich ist.

- Vergleich der Lieferwege - Vergleichen Sie Nachrüstung, stufenweise Aufrüstung, modulare Erweiterung oder Neubau hinsichtlich Kosten, Risiko, Zeitplan und Betriebsunterbrechung.

- Kommerzielle und regulatorische Überprüfung - Bestätigen Sie die Auswirkungen auf Genehmigungen, Nachhaltigkeit, Berichterstattung und Verträge.

- Umsetzung in Phasen - Abstimmung der Bereitstellungsreihenfolge mit dem laufenden Betrieb, den Beschaffungszeiten und der Verfügbarkeit von Versorgungsleistungen.

Eine einfache Entscheidungshilfe ist oft nützlich:

- Behalten und optimieren wenn die bestehende Infrastruktur über einen glaubwürdigen Spielraum verfügt und der KI-Einsatz moderat ist

- Selektiv nachrüsten wenn das Gebäude lebensfähig ist, aber wichtige mechanische und elektrische Systeme gezielt modernisiert werden müssen

- Modular ausbauen wenn das Wachstum real ist, aber die Unsicherheit über die Enddichte oder die Kundennachfrage bestehen bleibt

- Entwicklung von Neubauprojekten wenn der Nutzen, die Widerstandsfähigkeit, die Anlage oder die Struktur für eine Nachrüstung nicht ausreichend sind

Dieser Rahmen ist wertvoll, weil er die technischen Möglichkeiten von den kommerziellen trennt.

Wählen Sie eine KI-gesteuerte Entwicklung für Ihr Rechenzentrum

Sind Sie bereit, Ihr Rechenzentrum zu verbessern, um den Anforderungen der KI-gesteuerten Zukunft gerecht zu werden? Azura Consultancy bietet Ihnen modernste Lösungen, die Effizienz, Skalierbarkeit und Nachhaltigkeit gewährleisten. Unser Expertenteam hilft Ihnen, das volle Potenzial von KI und innovativen Technologien zu nutzen. Kontaktieren Sie uns noch heute, um Ihre Reise zu einem intelligenteren, leistungsfähigeren Rechenzentrum zu beginnen.

Wie Azura Consultancy helfen kann

Azura Consultancy unterstützt AI-Rechenzentrumsprojekte mit einer Kombination aus Front-End-Engineering, Infrastrukturdesign, Fachanalysen und technischer Due Diligence. Das dokumentierte Leistungsspektrum für Rechenzentren umfasst Machbarkeitsstudien, Standortauswahl, Design von Datenhallen und kritischen MEP-Systemen, Unterstützung für modulare Lösungen, Wärmerückgewinnung, Stromerzeugung vor Ort, Energiespeicherung, Automatisierung und Steuerung, Design der Netzwerkinfrastruktur, CFD-Analyse, Analyse des elektrischen Energiesystems, Zuverlässigkeitsstudien, BIM-Koordination und Unterstützung für Uptime-Tier-Zertifizierungspfade.

Einschlägige Unterstützung kann Folgendes umfassen:

- Durchführbarkeitsstudien und Standortauswahl

- Planung von Datenhallen und kritischer MEP-Infrastruktur

- Überprüfung der Kühlstrategie und der Wärmeabfuhr

- CFD-Analyse und thermische Validierung

- Analyse elektrischer Energiesysteme, einschließlich Überprüfung von Kurzschlüssen und Oberschwingungen

- Studien zur Zuverlässigkeit und Verfügbarkeit

- Zeitgemäßes Design und Unterstützung bei der Zertifizierung

- Netzinfrastruktur und Input für die Glasfaserplanung

- BIM-Koordinierung, Kollisionsprüfung und Unterstützung bei der schrittweisen Auslieferung

- technische Due-Diligence-Prüfungen für Übernahmen, Finanzierungs- oder Expansionsentscheidungen

Dies ist in vier Situationen besonders wertvoll:

- Standort- und Konzeptauswahl, wenn die Kunden wissen müssen, ob eine KI-Strategie an einem bestimmten Ort realistisch ist

- Entwicklung des Designs, wenn Dichte, Widerstandsfähigkeit und Nachhaltigkeitsziele miteinander in Einklang gebracht werden müssen

- Bewertung von Nachrüstungen und Industriebrachen, wo versteckte Zwänge scheinbar attraktive Vermögenswerte untergraben können

- Überprüfung von Investitionen und Kreditgebern, in denen technische Annahmen objektiv geprüft werden müssen

Azuras öffentliche Bescheinigungen dieses Angebot in einer Weise zu stärken, die für reale Projektentscheidungen relevant ist und nicht nur für die Markenpositionierung. Die Zertifizierungsseite enthält ISO 9001:2015 als Qualitätssignal auf Unternehmensebene, zusammen mit professionellen Referenzen wie Uptime ATD / ATD Expert, LEED AP, PMP, ASHRAE HBDP und ASHRAE HFDP.

Im Kontext betrachtet, unterstreichen diese Referenzen Azuras Fähigkeiten in den Bereichen Ausfallsicherheit von Rechenzentren, Qualitätsmanagement, Nachhaltigkeit, Gebäudesysteme und strukturierte Projektabwicklung.

Für Entscheidungen von Investoren, Kreditgebern und Übernahmen ist die Stärke der technischen Prüfung genauso wichtig wie die Angabe der Kapazität. Die technische Due-Diligence-Fähigkeit von Azura berücksichtigt bei der Prüfung von Rechenzentren explizit die Machbarkeit, die Energie- und Kühlsysteme, die Ausfallsicherheit und Redundanz, die Skalierbarkeit, die Einhaltung gesetzlicher Vorschriften und die Sicherheit - die richtige Brille, um zu prüfen, ob die Behauptungen “KI-fähig” in der Praxis bankfähig sind.

Der Wert liegt nicht nur in besserer Technik. Es ist eine bessere Entscheidungsqualität: klarere Zwänge, weniger falsche Annahmen und ein glaubwürdigerer Weg vom Konzept zum Betrieb.

Praktische nächste Schritte

Wenn Sie die Bereitschaft von KI-Rechenzentren bewerten, sollten die ersten Prüfungen in der Regel sein:

- das angestrebte AI-Arbeitslastprofil und den erwarteten Dichtebereich definieren

- die Verfügbarkeit von Strom und den Zeitpunkt der Lieferung bestätigen

- Überprüfung der Kühltopologie anhand des geplanten Lastprofils

- Bewertung des Resilienzmodells und der Expansionsannahmen

- thermische und elektrische Validierungsstudien durchführen

- Überprüfung der Netzarchitektur, der Leitungskapazität und der Annahmen für die Zusammenschaltung

- Vergleich zwischen Nachrüstung, schrittweisem Ausbau und Neubau

- Prüfung der Auswirkungen auf die regionale Einhaltung von Vorschriften, Nachhaltigkeit und Berichterstattung

- Umsetzung der Ergebnisse in einen gestaffelten Investitions- und Lieferplan

Wenn es sich um ein akquisitorisches Projekt handelt, sollte die gleiche Abfolge in eine technische Due-Diligence-Prüfung integriert werden, bevor größere kommerzielle Verpflichtungen eingegangen werden.

Schlussfolgerung

KI-Rechenzentren werden nicht allein durch die Marketingsprache oder das Vorhandensein von beschleunigten Rechenleistungen definiert. Sie werden dadurch definiert, ob die umgebende Infrastruktur eine höhere Dichte und hochwertige Arbeitslasten mit glaubwürdiger Energieversorgung, Kühlung, Netzwerkleistung, Ausfallsicherheit und Betriebskontrolle unterstützen kann.

Für Eigentümer, Betreiber, Entwickler, Investoren und Kreditgeber liegt der Unterschied zwischen einer plausiblen und einer vertretbaren KI-Strategie in der Regel in der Qualität des Front-End-Engineerings, in einer disziplinierten Validierung und in einem realistischen Verständnis von Beschränkungen.

Azura Consultancy ist mit seiner Kombination aus Rechenzentrumsdesign, technischer Due Diligence, BIM-gestützter Koordination, spezialisierter technischer Analyse und relevanten Qualitäts- und Berufszertifizierungen gut positioniert, um diese Entscheidungen mit praktischer technischer Strenge und nicht mit allgemeinen Behauptungen über die “KI-Fähigkeit” zu unterstützen.

Für Unternehmen, die eine Ausweitung der KI in Betracht ziehen, besteht der nächste Schritt nicht darin, die Bereitschaft zu übertreiben. Er besteht darin, sie mit Unterstützung erfahrener Mitarbeiter zu validieren. Berater für Rechenzentren.

AI-Rechenzentrum: Häufigste Fragen

Ein KI-Rechenzentrum ist eine spezialisierte Einrichtung, die für die rechenintensiven Anforderungen von Anwendungen der künstlichen Intelligenz (KI) und des maschinellen Lernens (ML) konzipiert ist. Diese Rechenzentren sind mit Hochleistungshardware wie GPUs, TPUs und anderen Beschleunigern ausgestattet, um den hohen Bedarf an Rechenleistung und Speicherplatz für KI-Workloads zu bewältigen.

Der Hauptunterschied besteht nicht nur in der Rechenhardware. KI-Einrichtungen erfordern in der Regel ein dichteres Stromversorgungs- und Kühlungsdesign, eine höhere Netzwerkleistung, stärker integrierte Steuerungen und eine sorgfältigere Erweiterungsplanung.

GPUs (Graphics Processing Units) und TPUs (Tensor Processing Units) sind in KI-Rechenzentren von entscheidender Bedeutung, da sie für die parallele Verarbeitung von KI- und ML-Aufgaben ausgelegt sind. Diese Einheiten können mehrere Operationen gleichzeitig verarbeiten, wodurch die Berechnung komplexer KI-Modelle im Vergleich zu herkömmlichen CPUs (Central Processing Units) erheblich beschleunigt wird.

Die Flüssigkeitskühlung ist in KI-Rechenzentren aufgrund der hohen Wärmeabgabe von dicht gepackter Hochleistungs-Computerhardware unerlässlich. Flüssigkeitskühlsysteme leiten die Wärme effizient ab, indem sie Kühlmittel verwenden, die die Wärme von den Komponenten aufnehmen und ableiten, um optimale Betriebstemperaturen zu gewährleisten und Überhitzung zu vermeiden.

KI wird im Rechenzentrumsbetrieb eingesetzt, um die Effizienz und Zuverlässigkeit zu verbessern. KI-gesteuerte Systeme können den Energieverbrauch vorhersagen und verwalten, die Kühlung optimieren, eine vorausschauende Wartung durchführen, um Hardwareausfälle zu verhindern, und Arbeitslasten ausgleichen, um Spitzenleistungen zu gewährleisten. Diese Optimierungen senken die Betriebskosten und verbessern die Gesamteffizienz des Rechenzentrums.

Exascale Computing bezeichnet Systeme, die mindestens einen Exaflop oder eine Milliarde Milliarden (10^18) Berechnungen pro Sekunde durchführen können. Diese Rechenleistung ist entscheidend für die Verarbeitung riesiger Datensätze und komplexer Algorithmen, die in fortschrittlichen KI-Anwendungen verwendet werden, und ermöglicht eine schnellere Verarbeitung und genauere Ergebnisse.

KI-Rechenzentren tragen zur Nachhaltigkeit bei, indem sie energieeffiziente Technologien und Verfahren einsetzen. KI-gestützte Systeme optimieren den Energieverbrauch, integrieren erneuerbare Energiequellen und nutzen Wärmerückgewinnungssysteme zur Wiederverwendung überschüssiger Wärme. Diese Maßnahmen reduzieren die Umweltbelastung und die Betriebskosten von Rechenzentren.

Die Verwaltung eines KI-Rechenzentrums bringt mehrere Herausforderungen mit sich. Dazu gehören die Sicherstellung einer ausreichenden Energieversorgung und Kühlung für Hardware mit hoher Dichte, die Aufrechterhaltung einer robusten Sicherheit zum Schutz sensibler Daten, die effiziente Verwaltung großer Datenmengen und die kontinuierliche Aktualisierung der Infrastruktur, um mit den sich schnell entwickelnden KI-Technologien Schritt zu halten.

Die Zukunft der KI-Rechenzentren wird durch die Einführung neuer Technologien wie neuromorphes Computing und Quantencomputing geprägt sein, die eine weitere Verbesserung der Verarbeitungsmöglichkeiten versprechen. Darüber hinaus wird der Schwerpunkt weiterhin auf der Nachhaltigkeit liegen, wobei KI-gesteuerte Optimierungen und innovative Energielösungen eine wichtige Rolle bei der Verringerung der Umweltbelastung und der Betriebskosten spielen werden.

KI-Rechenzentren werden durch eine Kombination aus fortschrittlicher Hochleistungs-Computing-Hardware, wie GPUs und TPUs, und ausgeklügelten Stromversorgungssystemen betrieben. Darüber hinaus integrieren viele KI-Rechenzentren erneuerbare Energiequellen wie Solar- und Windenergie, um einen nachhaltigeren Betrieb zu gewährleisten. KI-gesteuerte Energiemanagementsysteme optimieren die Nutzung der verfügbaren Energie, gleichen die Lasten aus und reduzieren die Verschwendung.

Der Stromverbrauch eines KI-Rechenzentrums hängt von seiner Größe und der Dichte seiner Hardware ab. KI-Rechenzentren können zwischen einigen Megawatt (MW) und Hunderten von Megawatt verbrauchen. Insbesondere KI-Rechenzentren mit hoher Dichte können beträchtliche Energieressourcen erfordern, wobei einige der größten Einrichtungen bis zu 100 MW oder mehr verbrauchen, um ihre rechenintensiven Arbeitslasten zu unterstützen. Es wird erwartet, dass in den kommenden Jahren eine einzige Anlage die 1-GW-Grenze überschreiten könnte.

Der Aufbau eines KI-Rechenzentrums umfasst mehrere wichtige Schritte:

- Planung: Bewertung der Anforderungen an Rechenleistung, Speicher und Kühlung.

- Gestaltung: Schaffung eines Layouts, das eine hohe Hardware-Dichte und eine effiziente Kühlung unterstützt.

- Bauwesen: Aufbau der physischen Infrastruktur mit modernen Strom- und Kühlsystemen.

- Einrichtung: Einrichtung von Servern, GPUs, TPUs, Netzwerkausrüstung und anderer notwendiger Hardware.

- Optimierung: Einführung von KI-gesteuerten Managementsystemen zur Verbesserung von Leistung und Effizienz.

- Wartung: Erstellung von Protokollen für regelmäßige Wartung und Upgrades, um den reibungslosen Betrieb des Rechenzentrums zu gewährleisten.

Die Vernetzung von KI-Rechenzentren umfasst den Einsatz einer Hochgeschwindigkeits-Netzwerkinfrastruktur mit geringer Latenz, um die massiven Datenübertragungs- und Kommunikationsanforderungen von KI-Workloads zu unterstützen. Dazu gehört der Einsatz fortschrittlicher Netzwerkgeräte wie Switches und Router mit hoher Bandbreite sowie optimierte Netzwerkarchitekturen, die die parallelen Verarbeitungsanforderungen von KI- und ML-Anwendungen bewältigen können. Effiziente Netzwerke sind entscheidend für die Gewährleistung eines nahtlosen Datenflusses und die Minimierung von Engpässen in KI-Rechenzentren.

Stromverfügbarkeit, Kühlkapazität, Ausfallsicherheit, Skalierbarkeit, Konformität, Standortbeschränkungen, Netzarchitektur sowie die Kosten und Störungen, die mit der Schließung einer Bereitschaftslücke verbunden sind.

Referenzen

https://energy.ec.europa.eu/topics/energy-efficiency/energy-efficiency-targets-directive-and-rules/energy-efficiency-directive/energy-performance-data-centres_en

https://energy.ec.europa.eu/news/commission-adopts-eu-wide-scheme-rating-sustainability-data-centres-2024-03-15_en