Von wissenschaftlichen Maschinen zu strategischer Infrastruktur

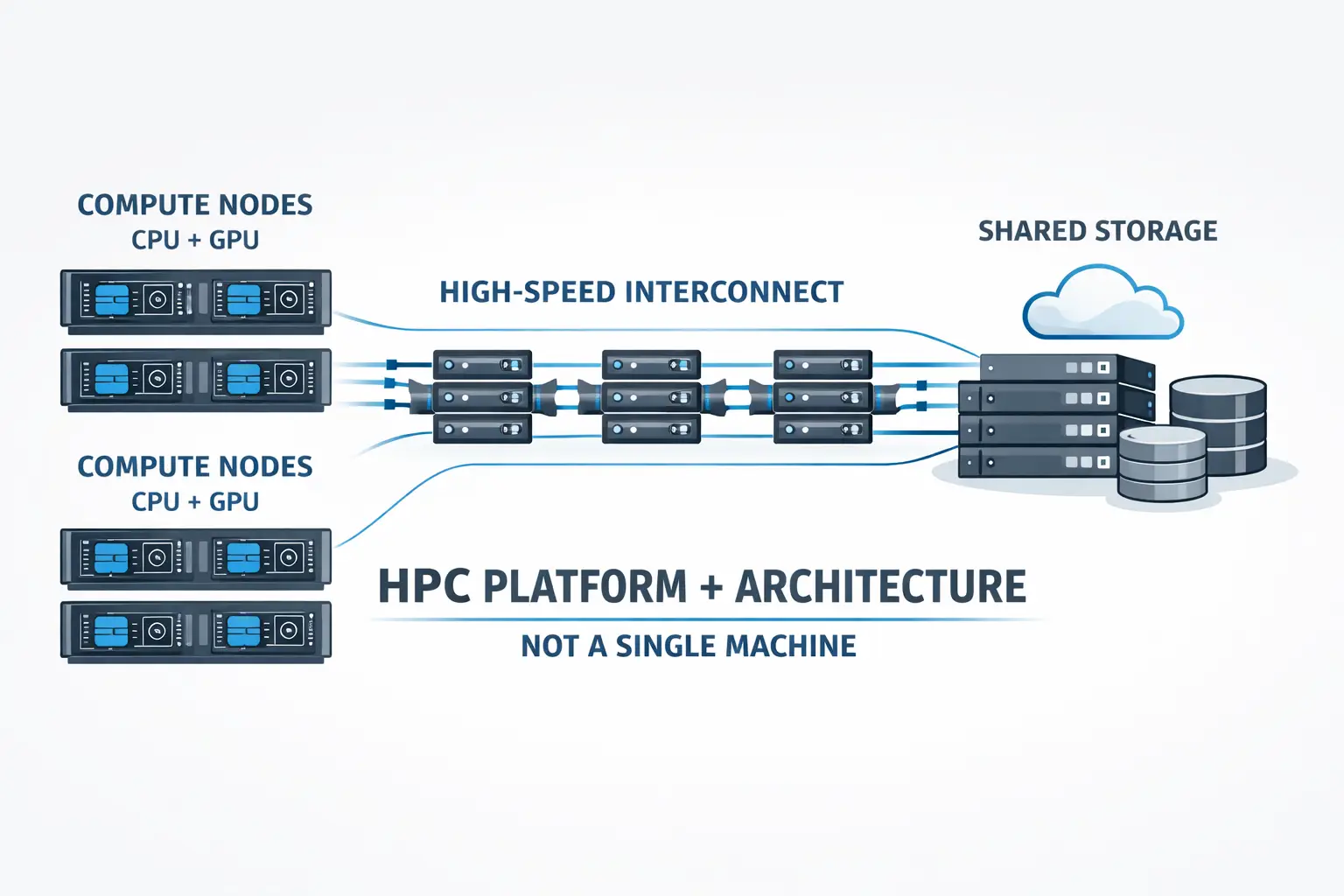

Hochleistungsrechner (High Performance Computing, HPC) haben einen grundlegenden Wandel durchlaufen. Früher vor allem mit akademischen Supercomputern und Nischenbereichen der wissenschaftlichen Forschung in Verbindung gebracht, sind HPC-Systeme heute ein zentraler Bestandteil der digitalen Welt – sie bilden die Grundlage für künstliche Intelligenz, industrielle Simulationen, Klimamodellierung, fortschrittliche Fertigung und nationale Technologiestrategien.

Im Jahr 2026 werden Hochleistungscomputer nicht mehr ausschließlich anhand ihrer Spitzen-FLOPS definiert. Stattdessen werden sie anhand der Lösungszeit, der Dauerleistung, der Energieeffizienz, der Skalierbarkeit und ihrer Fähigkeit, gemischte Workloads in den Bereichen KI, Simulation und Datenanalyse zu unterstützen, beurteilt. Infolgedessen sind Entscheidungen über HPC-Architektur, Standort, Leistung und Bereitstellung zu strategischen Infrastrukturentscheidungen mit langfristigen wirtschaftlichen und betrieblichen Konsequenzen geworden.

Dieser Artikel befasst sich mit der aktuellen Situation im Bereich High Performance Computing, warum dieser Bereich heute wichtiger denn je ist, wie moderne HPC-Systeme konzipiert sind und was Unternehmen bei der Planung und Bereitstellung einer HPC-Infrastruktur in einem sich schnell wandelnden Umfeld beachten müssen.

Was sind heute Hochleistungscomputer?

Im Kern ist ein Hochleistungscomputer ein System, das entwickelt wurde, um Rechenprobleme zu lösen, die für herkömmliche IT-Infrastrukturen unpraktisch oder unmöglich sind. Traditionell bedeutete dies eng gekoppelte Cluster, auf denen hochparallele wissenschaftliche Codes ausgeführt wurden.

Heute hat sich diese Definition erheblich erweitert.

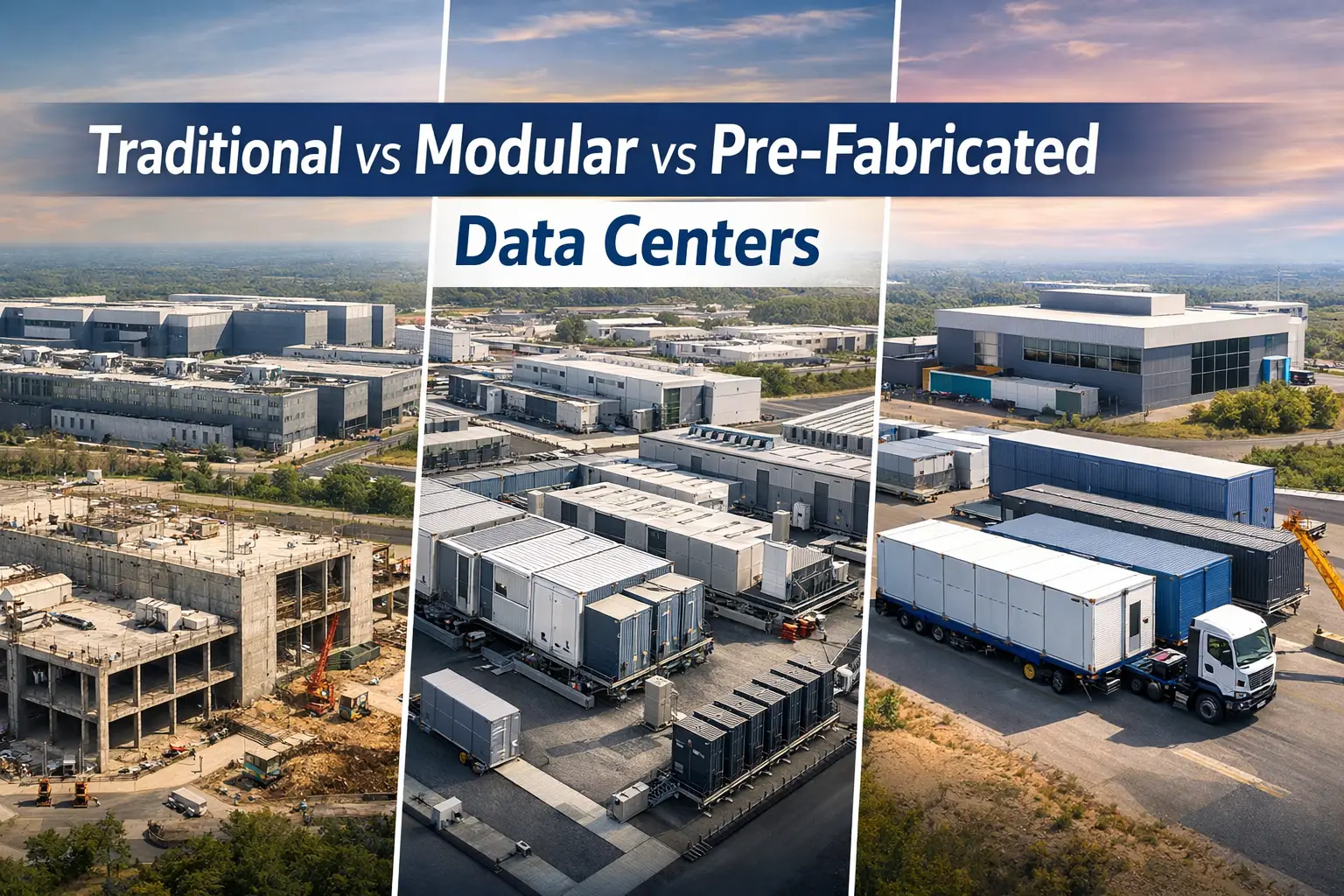

Moderne Hochleistungscomputer sind:

- Clusterbasierte Plattformen, keine monolithischen Maschinen

- Aufgebaut um Kombinationen aus CPU und Beschleuniger (GPUs, APUs und spezialisierte Beschleuniger)

- Entwickelt für den Betrieb heterogene Arbeitslasten, einschließlich:

- Groß angelegte Simulationen

- KI-Training und Inferenz

- Digitale Zwillinge

- Erweiterte Analytik

Anstatt nur einer einzigen Nutzergruppe zu dienen, unterstützen HPC-Plattformen zunehmend gemeinsam genutzte Multi-Tenant-Umgebungen, die Anwendungsfälle aus Forschung, Industrie, Start-ups und dem öffentlichen Sektor umfassen. Diese Entwicklung hat die historischen Grenzen zwischen HPC, KI-Infrastruktur und fortschrittlichem Rechenzentrumsdesign verwischt – ohne jedoch ihre unterschiedlichen Anforderungen zu beseitigen.

Warum Hochleistungsrechner wichtiger denn je sind

Mehrere konvergierende Kräfte haben HPC in den strategischen Fokus gerückt:

KI für die Wissenschaft und industrielle KI

HPC-Systeme spielen heute eine zentrale Rolle für:

- Training großer KI-Modelle

- Ausführung von KI-gestützten Simulationen

- Kombination physikalischer Modelle mit maschinellem Lernen

Diese Konvergenz hat die Nachfrage nach beschleunigtem Computing und Speicher mit hoher Bandbreite dramatisch erhöht.

Energie, Klima und Nachhaltigkeit

Hochauflösende Klimamodellierung, Gittersimulation, Wasserstoffforschung und Materialwissenschaften sind auf Berechnungen im HPC-Maßstab angewiesen. Diese Workloads sind kontinuierlich, datenintensiv und zunehmend geschäftskritisch.

Nationale und regionale Technologiestrategien

Regierungen betrachten Hochleistungscomputer heute als:

- Enabler der digitalen Souveränität

- Grundlagen für inländische KI-Kompetenz

- Langfristige strategische Vermögenswerte statt luxuriöser Forschungsprojekte

Infolgedessen hängen Investitionsentscheidungen im Bereich HPC zunehmend von politischen Entscheidungen, Resilienz und industrieller Wettbewerbsfähigkeit ab und nicht mehr nur von der technischen Leistungsfähigkeit.

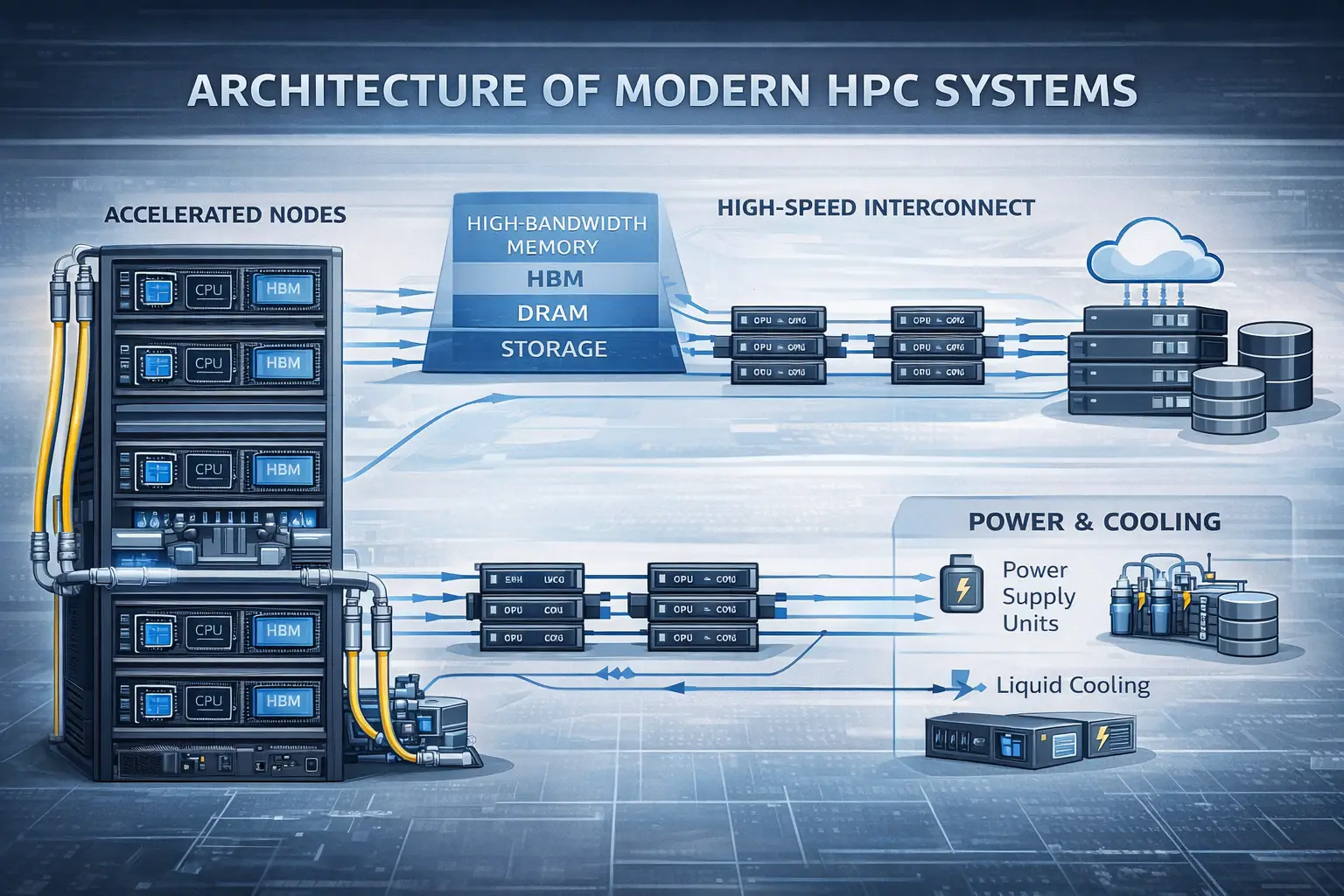

Die Architektur moderner Hochleistungsrechner

Beschleunigte Berechnung als Basis

Moderne HPC-Systeme sind auf Beschleuniger ausgelegt. GPUs und beschleunigerreiche Knoten bieten eine um Größenordnungen verbesserte Leistung pro Watt für KI- und Simulations-Workloads, wodurch sie unverzichtbar und nicht mehr optional sind.

Der Speicher ist der eigentliche Engpass

Bei vielen HPC-Anwendungen wird die Leistung weniger durch die Rechenleistung als vielmehr durch folgende Faktoren eingeschränkt:

- Speicherkapazität

- Speicherbandbreite

- Datenübertragung zwischen Knoten

Hochbandbreitenspeicher (HBM) und speicherbewusstes Software-Design spielen heute eine entscheidende Rolle für die Gesamteffizienz des Systems.

Stromversorgung und Kühlung als Einschränkungen erster Ordnung

Hochleistungscomputer arbeiten mit extremen Leistungsdichten. Flüssigkeitskühlung, fortschrittliche Stromverteilung und Wärmemanagement sind heute Standardaspekte bei der Konstruktion, die eng mit der Standortwahl und den langfristigen Betriebskosten verbunden sind.

Der Stoff ist Teil des Computers

In großem Maßstab bestimmt die Leistung der Verbindungen direkt die Effizienz der Anwendungen. Geringe Latenz, hohe Bandbreite und Überlastungskontrolle sind grundlegende Designparameter und keine zweitrangigen Überlegungen.

Hochleistungscomputer und KI-Rechenzentren: Verwandt, aber nicht identisch

Während Hochleistungscomputer und KI-Rechenzentren Technologien – Beschleuniger, Hochgeschwindigkeitsnetze, dichte Stromversorgung – werden zunehmend gemeinsam genutzt, doch ihre Design-Treiber und Betriebsmodelle unterscheiden sich.

Hochleistungscomputer sind in der Regel optimiert für:

- Eng gekoppelte parallele Workloads

- Vorhersehbare Leistung in großem Maßstab

- Wissenschaftliche und technische Genauigkeit

KI-Rechenzentren priorisieren häufig:

- Elastische Skalierung

- Inferenzdurchsatz

- Kommerzielle Bereitstellung von KI-Diensten

Es ist entscheidend zu verstehen, wo diese Modelle übereinstimmen – und wo sie voneinander abweichen. Ein detaillierter Vergleich wird in unserem speziellen Artikel untersucht: HPC vs. AI-Rechenzentren

Hochleistungsrechnen als strategische Infrastruktur

Eine der bedeutendsten Veränderungen der letzten Jahre ist die Neupositionierung von HPC als langfristige nationale und industrielle Infrastruktur.

Hochleistungsrechnen ist heute:

- Anker für regionale Innovationsökosysteme

- Plattform für öffentlich-private Zusammenarbeit

- Vertrauenswürdige Umgebung für sensible Daten und geistiges Eigentum

Diese Veränderung legt einen neuen Schwerpunkt auf:

- Governance-Modelle

- Zugriffsrahmen

- Langfristige Nachhaltigkeit und Expansionsplanung

HPC-Systeme werden nicht mehr für einzelne Projekte gebaut – sie sind darauf ausgelegt, sich über einen Zeitraum von zehn Jahren oder mehr an veränderte Arbeitslasten anzupassen.

Planung und Bereitstellung einer leistungsstarken Computerinfrastruktur

Während Prozessor-Roadmaps und Benchmarks Aufmerksamkeit erregen, hängt der Erfolg oder Misserfolg vieler HPC-Programme von frühzeitig getroffenen Entscheidungen ab, die nichts mit der Rechenleistung zu tun haben.

Wichtige Planungsaspekte sind unter anderem:

- Standortbereitschaft: Stromverfügbarkeit, Netzstabilität und physikalische Einschränkungen

- Skalierbarkeit: Stufenweises Wachstum ohne architektonische Sackgassen

- Netzwerkintegration: Campus-, Metro- und Weitverkehrsvernetzung

- Betriebskosten: Energieverbrauch unter Dauerlast

- Lieferungssteuerung: Risikomanagement in komplexen, mehrjährigen Programmen

Da HPC-Plattformen immer komplexer und kapitalintensiver werden, spielen unabhängige Machbarkeitsstudien, technische Due-Diligence-Prüfungen und Infrastrukturplanung eine entscheidende Rolle für den langfristigen Erfolg.

Was kommt als Nächstes für das Hochleistungsrechnen (2026–2030)?

Mit Blick auf die Zukunft werden mehrere Trends die nächste Generation von HPC prägen:

- Eine Verlagerung von Spitzenleistungsmetriken hin zu Durchsatz pro Watt und Zeit bis zur Lösung

- Größere, stärker integrierte Beschleunigerdomänen

- Stärkerer Fokus auf Speicherskalierbarkeit und Datenlokalität

- HPC-Plattformen, die speziell für gemischte KI- und Simulations-Workflows entwickelt wurden

- Nachhaltigkeit wird zu einer unverzichtbaren Designvorgabe

Anstatt immer höhere theoretische Leistungswerte anzustreben, liegt die Zukunft des Hochleistungsrechnens in einer effizienten, nutzbaren und widerstandsfähigen Infrastruktur.

Fazit: Hochleistungsrechner für langfristige Entscheidungen

Hochleistungsrechner sind nicht mehr nur Spezialgeräte, die in Forschungslabors versteckt sind. Sie sind eine strategische Infrastrukturplattform, die KI, industrielle Innovation und nationale Leistungsfähigkeit unterstützt.

Da die Bedeutung von HPC weiter zunimmt, werden frühzeitige Entscheidungen – in Bezug auf Architektur, Standort, Leistung, Skalierbarkeit und Bereitstellung – nicht nur die technische Leistung, sondern auch die Wirtschaftlichkeit und den strategischen Wert im Laufe der Zeit bestimmen.

Planen Sie Ihre Hochleistungs-Computerinfrastruktur mit Zuversicht

Von der Machbarkeit und Standortvorbereitung bis hin zur Liefersteuerung und langfristigen Skalierbarkeit hilft Ihnen Azura Consultancy dabei, Risiken bei HPC-Programmen zu minimieren und strategische Computing-Ziele in eine robuste, zukunftssichere Infrastruktur umzusetzen.

Wie Azura Consultancy Hochleistungscomputerprogramme unterstützt

Da Hochleistungscomputer sich zu einer langfristigen strategischen Infrastruktur entwickeln, liegen die größten Risiken selten in der Computerhardware selbst. Sie liegen vielmehr vorgelagert – in der Strategie, der Machbarkeit, der Standortbereitschaft, der Stromverfügbarkeit, der Netzwerkintegration und der Liefersteuerung.

Azura Consultancy unterstützt Unternehmen in dieser entscheidenden Anfangsphase und hilft Kunden dabei, ihre HPC-Ziele in robuste, realisierbare und zukunftssichere Infrastrukturprogramme umzusetzen. Unsere Arbeit umfasst Machbarkeitsstudien in der Frühphase, Standort- und Leistungsbewertungen, architekturunabhängige Beratung und technische Due Diligence – damit HPC-Investitionen vom ersten Tag an mit den betrieblichen Gegebenheiten, regulatorischen Auflagen und langfristigen Wachstumszielen im Einklang stehen.

Entscheidend ist, dass Azura unabhängig von OEMs und Anbietern arbeitet. So können wir uns auf das konzentrieren, was für das Programm richtig ist, und nicht auf das, was zu einer bestimmten Produkt-Roadmap passt. Wir helfen Kunden aus dem öffentlichen und privaten Sektor dabei, Risiken bei komplexen HPC-Initiativen zu minimieren, indem wir uns vor der Kapitalbindung mit Skalierbarkeit, Energieeffizienz, Kühlungsstrategien, Netzwerkarchitektur und Bereitstellungsmodellen befassen.

Da HPC-Plattformen für KI, industrielle Innovation und nationale Leistungsfähigkeit immer wichtiger werden, bietet Azura die strategische, technische und lieferungsorientierte Beratung, die erforderlich ist, um Hochleistungsrechner von einem technischen Ziel in eine robuste, nachhaltige Infrastruktur zu verwandeln, die nicht nur bei der Inbetriebnahme, sondern über Jahrzehnte hinweg funktioniert.