Van wetenschappelijke machines tot strategische infrastructuur

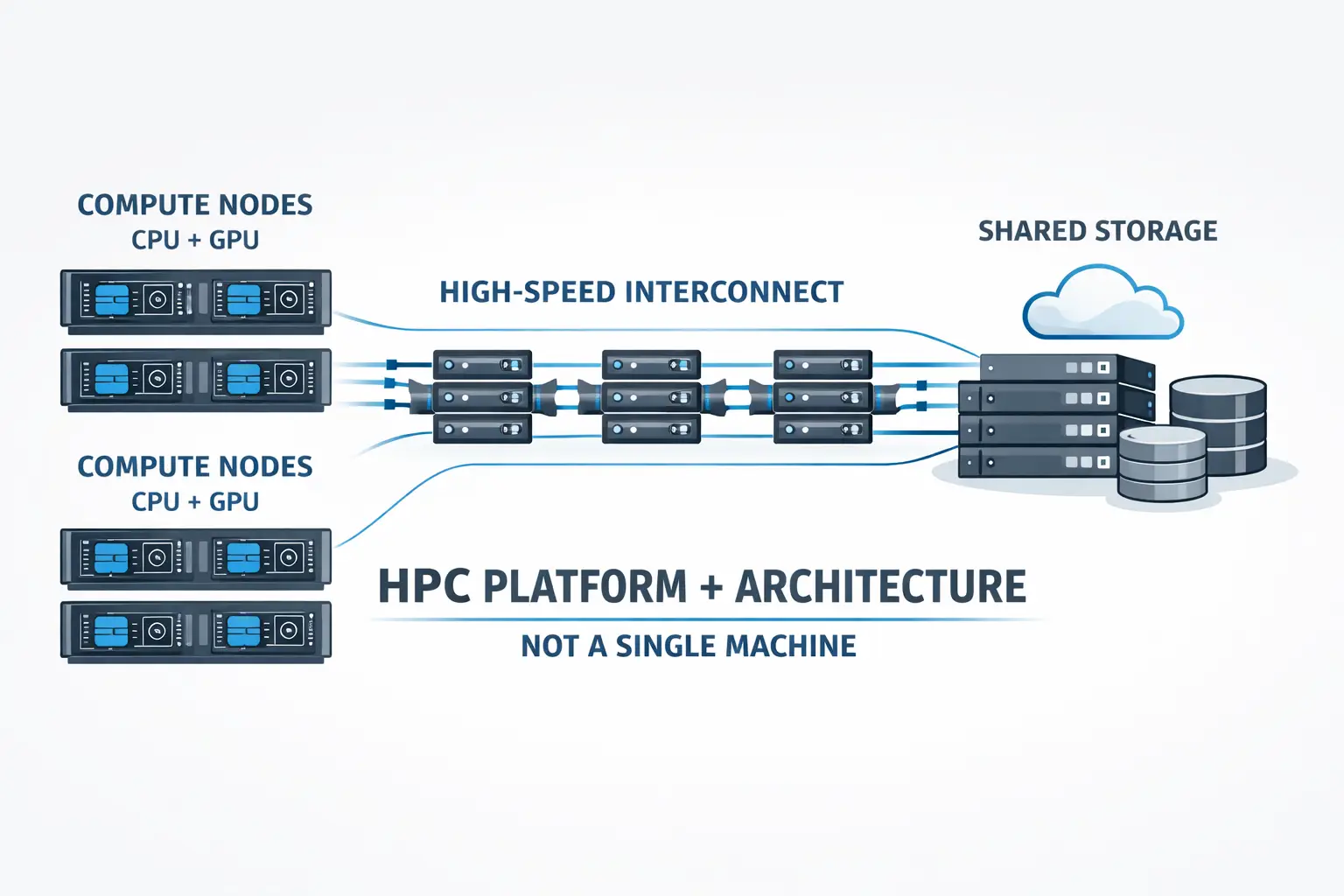

High Performance Computing (HPC) heeft een fundamentele transformatie ondergaan. Ooit voornamelijk geassocieerd met academische supercomputers en nichewetenschappelijk onderzoek, zijn HPC-systemen nu van cruciaal digitaal belang — ze vormen de basis voor kunstmatige intelligentie, industriële simulatie, klimaatmodellering, geavanceerde productie en nationale technologiestrategieën.

In 2026 zullen high-performance computers niet langer uitsluitend worden gedefinieerd door hun piek-FLOPS. In plaats daarvan worden ze beoordeeld op basis van de tijd die nodig is om tot een oplossing te komen, hun duurzame prestaties, energie-efficiëntie, schaalbaarheid en hun vermogen om gemengde workloads op het gebied van AI, simulatie en data-analyse te ondersteunen. Als gevolg daarvan zijn beslissingen over HPC-architectuur, locatie, vermogen en levering strategische infrastructuurkeuzes geworden met economische en operationele gevolgen op de lange termijn.

Dit artikel onderzoekt hoe High Performance Computing er vandaag de dag uitziet, waarom het belangrijker is dan ooit, hoe moderne HPC-systemen worden ontworpen en waar organisaties rekening mee moeten houden bij het plannen en leveren van HPC-infrastructuur in een snel veranderende omgeving.

Wat zijn tegenwoordig krachtige computers?

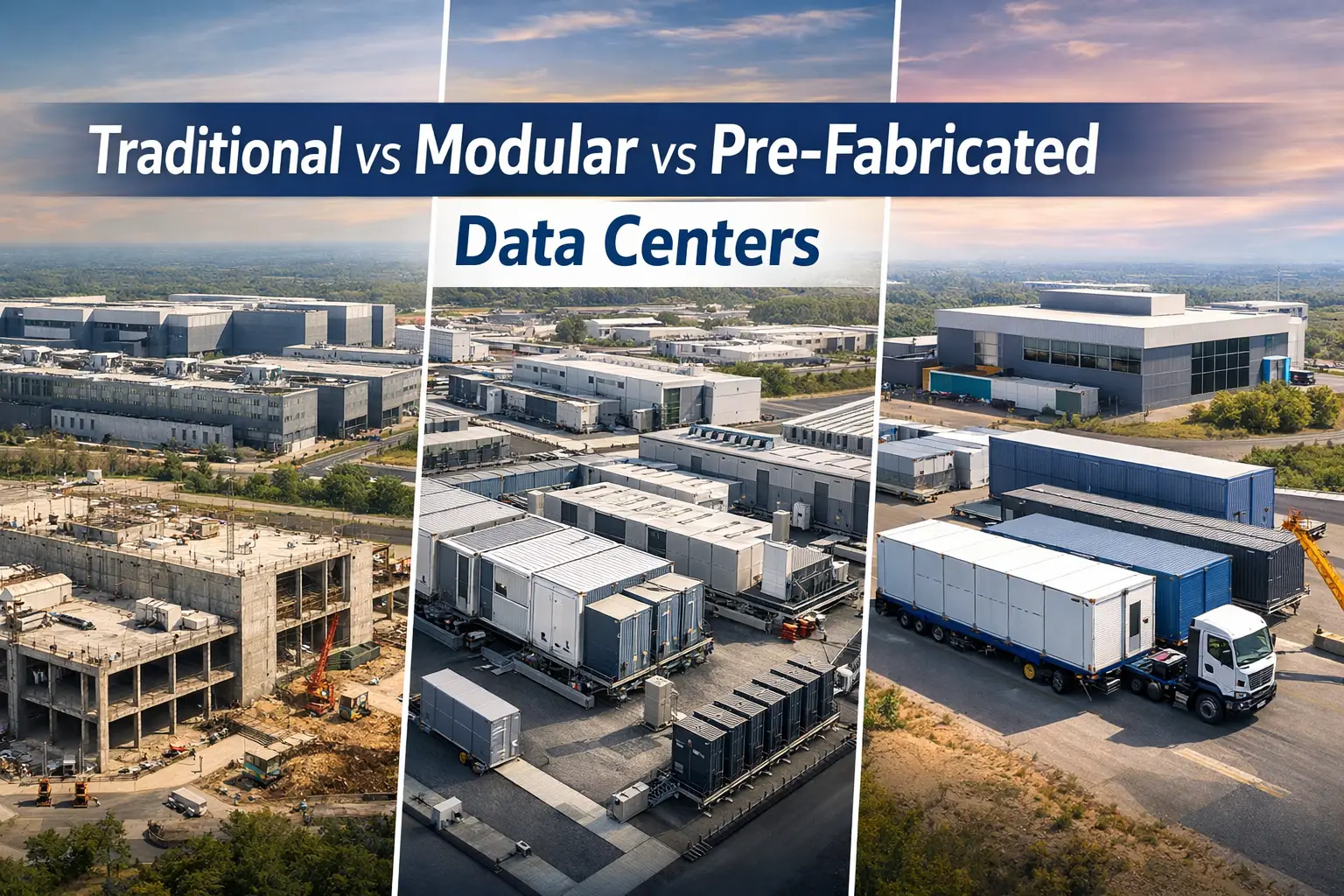

In essentie is een high-performance computer een systeem dat is ontworpen om rekenkundige problemen op te lossen die voor conventionele IT-infrastructuur onpraktisch of onmogelijk zijn. Traditioneel betekende dit nauw gekoppelde clusters die zeer parallelle wetenschappelijke codes uitvoerden.

Vandaag de dag is die definitie aanzienlijk uitgebreid.

Moderne high-performance computers zijn:

- Clustergebaseerde platforms, geen monolithische machines

- Gebouwd rond Combinaties van CPU en versneller (GPU's, APU's en gespecialiseerde versnellers)

- Ontworpen om te draaien heterogene werklasten, waaronder:

- Grootschalige simulaties

- AI-training en -inferentie

- Digitale tweelingen

- Geavanceerde analyse

In plaats van één enkele groep gebruikers te bedienen, ondersteunen HPC-platforms steeds vaker gedeelde, multi-tenant omgevingen voor onderzoek, industrie, start-ups en gebruiksscenario's in de publieke sector. Deze evolutie heeft de historische grenzen tussen HPC, AI-infrastructuur en geavanceerd datacenterontwerp doen vervagen, zonder dat hun specifieke vereisten zijn verdwenen.

Waarom high-performance computing belangrijker is dan ooit

Verschillende samenkomende krachten hebben HPC in de strategische schijnwerpers gezet:

AI voor wetenschap en industriële AI

HPC-systemen spelen nu een centrale rol bij:

- Training van grote AI-modellen

- AI-verbeterde simulaties uitvoeren

- Fysica-gebaseerde modellen combineren met machine learning

Deze convergentie heeft de vraag naar versnelde computing en geheugen met hoge bandbreedte drastisch doen toenemen.

Energie, klimaat en duurzaamheid

Klimaatmodellering met hoge resolutie, gridsimulatie, waterstofonderzoek en materiaalkunde zijn afhankelijk van HPC-schaalberekeningen. Deze workloads zijn continu, data-intensief en worden steeds belangrijker voor de missie.

Nationale en regionale technologiestrategieën

Overheden beschouwen high-performance computers nu als:

- Faciliteerders van digitale soevereiniteit

- Basis voor binnenlandse AI-capaciteit

- Strategische activa voor de lange termijn in plaats van luxe onderzoeksprojecten

Als gevolg daarvan worden investeringsbeslissingen op het gebied van HPC steeds meer gekoppeld aan beleid, veerkracht en industriële concurrentiekracht, en niet alleen aan technische prestaties.

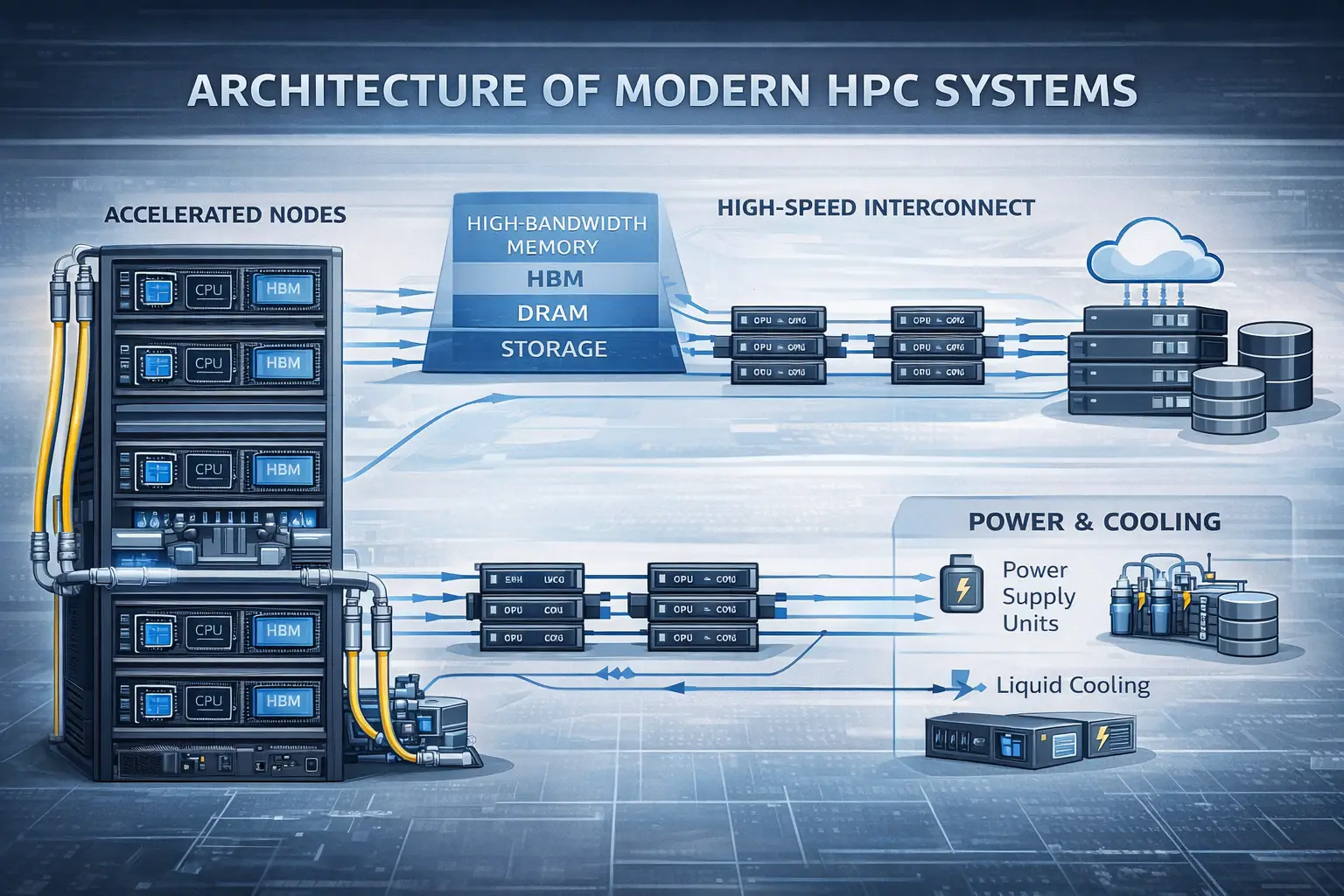

De architectuur van moderne high-performance computing

Versnelde rekenkracht als uitgangspunt

Moderne HPC-systemen zijn ontworpen rond versnellers. GPU's en knooppunten met veel versnellers zorgen voor een aanzienlijke verbetering van de prestaties per watt voor AI- en simulatiewerkzaamheden, waardoor ze essentieel zijn in plaats van optioneel.

Geheugen is de echte bottleneck

Voor veel HPC-toepassingen wordt de prestatie minder beperkt door rekenkracht en meer door:

- Geheugencapaciteit

- Geheugenbandbreedte

- Gegevensverkeer tussen knooppunten

High-bandwidth memory (HBM) en geheugenbewust softwareontwerp spelen nu een cruciale rol in de algehele effectiviteit van het systeem.

Vermogen en koeling als eerste orde beperkingen

High Performance Computers werken bij extreme vermogensdichtheden. Vloeistofkoeling, geavanceerde stroomverdeling en warmtebeheer zijn nu standaardontwerpoverwegingen, die nauw verbonden zijn met de locatiekeuze en de exploitatiekosten op lange termijn.

De stof maakt deel uit van de computer

Op grote schaal bepaalt de prestatie van de interconnectie rechtstreeks de efficiëntie van de toepassing. Lage latentie, hoge bandbreedte en congestiebeheersing zijn fundamentele ontwerpparameters, geen secundaire overwegingen.

Krachtige computers en AI-datacenters: verwant, maar niet identiek

Terwijl Krachtige computers en AI-datacenters steeds meer technologieën delen – versnellers, hogesnelheidsnetwerken, dichte stroomvoorziening – maar hun ontwerpdoelstellingen en operationele modellen verschillen.

High Performance Computers zijn doorgaans geoptimaliseerd voor:

- Nauw gekoppelde parallelle workloads

- Voorspelbare prestaties op grote schaal

- Wetenschappelijke en technische nauwkeurigheid

AI-datacenters geven vaak prioriteit aan:

- Elastische schaalbaarheid

- Inferentie-doorvoer

- Commerciële levering van AI-diensten

Het is van cruciaal belang om te begrijpen waar deze modellen overeenkomen en waar ze uiteenlopen. Een gedetailleerde vergelijking wordt onderzocht in ons speciale artikel: HPC vs AI-datacenters

High Performance Computing als strategische infrastructuur

Een van de belangrijkste verschuivingen van de afgelopen jaren is de herpositionering van HPC als nationale en industriële infrastructuur voor de lange termijn.

High Performance Computing is nu:

- Anker voor regionale innovatie-ecosystemen

- Platform voor publiek-private samenwerking

- Betrouwbare omgeving voor gevoelige gegevens en intellectueel eigendom

Deze verschuiving legt een nieuwe nadruk op:

- Bestuursmodellen

- Toegangskaders

- Duurzaamheid op lange termijn en uitbreidingsplanning

HPC-systemen worden niet langer gebouwd voor afzonderlijke projecten, maar zijn ontworpen om gedurende tien jaar of langer aan veranderende werkbelastingen te voldoen.

Planning en levering van hoogwaardige computerinfrastructuur

Hoewel processorroadmaps en benchmarks veel aandacht trekken, slagen of mislukken veel HPC-programma's op basis van niet-computergerelateerde beslissingen die in een vroeg stadium worden genomen.

Belangrijke overwegingen bij de planning zijn onder meer:

- Gereedheid van de locatie: stroomvoorziening, veerkracht van het elektriciteitsnet en fysieke beperkingen

- Schaalbaarheid: gefaseerde groei zonder architecturale doodlopende wegen

- Netwerkintegratie: campus-, metro- en wide area-connectiviteit

- Operationele kosten: energieverbruik bij aanhoudende belasting

- Leveringsbeheer: risicobeheer in complexe, meerjarige programma's

Naarmate HPC-platforms complexer en kapitaalintensiever worden, spelen onafhankelijke haalbaarheidsstudies, technische due diligence en infrastructuurplanning een doorslaggevende rol in het succes op lange termijn.

Wat staat er te gebeuren op het gebied van high-performance computing (2026–2030)?

In de toekomst zullen verschillende trends de volgende generatie HPC vormgeven:

- Een verschuiving van piekprestatiestatistieken naar doorvoer per watt en tijd tot oplossing

- Grotere, beter geïntegreerde acceleratordomeinen

- Meer aandacht voor schaalbaarheid van het geheugen en gegevenslokaliteit

- HPC-platforms die specifiek zijn ontworpen voor gemengde AI- en simulatieworkflows

- Duurzaamheid wordt een niet-onderhandelbare ontwerpbeperking

In plaats van te streven naar steeds hogere theoretische prestaties, ligt de toekomst van High Performance Computing in een efficiënte, bruikbare en veerkrachtige infrastructuur.

Conclusie: High Performance Computing voor langetermijnbeslissingen

High Performance Computing is niet langer een toepassing van gespecialiseerde machines die verborgen zijn in onderzoekslaboratoria. Het is een strategisch infrastructuurplatform dat ten grondslag ligt aan AI, industriële innovatie en nationale capaciteit.

Naarmate de rol van HPC steeds groter wordt, zullen beslissingen in een vroeg stadium – over architectuur, locatie, vermogen, schaalbaarheid en levering – niet alleen bepalend zijn voor de technische prestaties, maar ook voor de economische haalbaarheid en strategische waarde op de lange termijn.

Plan uw hoogwaardige computerinfrastructuur met vertrouwen

Van haalbaarheid en gereedheid van de locatie tot leveringsbeheer en schaalbaarheid op lange termijn: Azura Consultancy helpt u de risico's van HPC-programma's te verminderen en strategische computerambities om te zetten in een veerkrachtige, toekomstbestendige infrastructuur.

Hoe Azura Consultancy hoogwaardige computerprogramma's ondersteunt

Naarmate high-performance computers zich ontwikkelen tot strategische infrastructuur voor de lange termijn, liggen de belangrijkste risico's zelden in de computerhardware zelf. Ze liggen stroomopwaarts: in de strategie, haalbaarheid, gereedheid van de locatie, beschikbaarheid van stroom, netwerkintegratie en leveringsbeheer.

Azura Consultancy ondersteunt organisaties bij deze beslissende eerste stap en helpt klanten hun HPC-ambities te vertalen naar robuuste, bouwbare en toekomstbestendige infrastructuurprogramma's. Ons werk omvat haalbaarheidsstudies in een vroeg stadium, locatie- en stroombeoordelingen, architectuuronafhankelijk advies en technische due diligence. Zo zorgen we ervoor dat HPC-investeringen vanaf dag één aansluiten bij de operationele realiteit, wettelijke beperkingen en langetermijngroeidoelstellingen.

Cruciaal is dat Azura onafhankelijk van OEM's en leveranciers opereert. Hierdoor kunnen we ons richten op wat goed is voor het programma, en niet op wat past in een bepaalde productroadmap. We helpen klanten in de publieke en private sector om complexe HPC-initiatieven minder risicovol te maken door schaalbaarheid, energie-efficiëntie, koelingsstrategieën, netwerkarchitectuur en leveringsmodellen aan te pakken voordat er kapitaal wordt geïnvesteerd.

Nu HPC-platforms steeds belangrijker worden voor AI, industriële innovatie en nationale capaciteit, biedt Azura de strategische, technische en leveringsgerichte begeleiding die nodig is om high-performance computing te transformeren van een technische ambitie naar een veerkrachtige, duurzame infrastructuur die tientallen jaren lang presteert – en niet alleen bij de ingebruikname.