Einführung

KI als Dienstleistung (AIaaS) liefert künstliche Intelligenz auf Anfrage - Think Plattformen für maschinelles Lernen als Dienstleistung die es Ihnen ermöglichen, Modelle zu trainieren, fein abzustimmen, bereitzustellen und zu überwachen, ohne die umfangreiche Infrastruktur selbst aufbauen und betreiben zu müssen. Anstatt GPUs zu kaufen, Datenpipelines aufzubauen und spezialisierte MLOps-Teams zu beschäftigen, abonnieren Unternehmen Managed Services, die Rechenleistung, Tools, Sicherheit und Lebenszyklusbetrieb bündeln. Das Ergebnis sind schnellere Experimente, ein geringeres Anfangsrisiko und ein direkter Weg von den Daten zu den Entscheidungen - ganz gleich, ob Sie eine vorausschauende Wartung, einen intelligenten Kundensupport, eine Betrugserkennung oder Analysen auf Stadtebene einführen wollen.

AIaaS ist auf dem Vormarsch, weil es Unternehmen dort abholt, wo sie stehen: enge Zeitvorgaben, begrenzte interne KI-Kenntnisse und der Auftrag, schnell einen Mehrwert zu schaffen. Durch die Nutzung von KI über APIs und verwaltete Plattformen können Teams Anwendungsfälle innerhalb von Tagen testen, Gewinner global skalieren und die Ausgaben an die Nutzung anpassen - und das bei gleichzeitiger Integration in bestehende DevOps-Prozesse, Colocation-Footprints oder Rechenzentrum als Dienstleistung (DCaaS) Umgebungen.

AIaaS-Kernmodell

Modell-Lebenszyklus-Dienste

- Schulung und Feinabstimmung: Verwaltete Pipelines für Datenvorbereitung, verteiltes Training, Hyperparametersuche, Checkpointing und Auswertung.

- Ableiten & Servieren: Automatisch skalierte Endpunkte (CPU/GPU/Beschleuniger) mit A/B-Tests, Canary Releases und Modell-Rollback.

- MLOps-Werkzeuge: Funktionsspeicher, Verfolgung von Experimenten, Überwachung von Drift und Qualität sowie Auslöser für Umschulungen.

Gebrauchsfertige AI-APIs

- Natürliche Sprache (NLP): Textklassifizierung, Zusammenfassung, Übersetzung, Gesprächsagenten.

- Computer Vision: Objekterkennung, OCR, Qualitätskontrolle, Sicherheitsüberwachung.

- Sprache & Audio: Sprache-zu-Text, Text-zu-Sprache, Sprecherverifizierung.

- Empfehlung und Vorhersage: Next-Best-Action, Nachfrageprognose, Erkennung von Anomalien.

Vorgefertigt vs. Individuell

- Vorgefertigte Modelle/APIs beschleunigen die Time-to-Value und sind ideal für allgemeine Aufgaben mit Standarddaten.

- Kundenspezifische Modelle (feinabgestimmt oder von Grund auf neu trainiert) gewinnen, wenn die Anforderungen an Daten, Governance oder Genauigkeit die Möglichkeiten von Standardmodellen übersteigen.

Geschäftliche Vorteile von AIaaS

- Niedrigere Einstiegshürde: Starten Sie Proofs-of-Concept, ohne Hardware zu kaufen oder große Plattformteams zusammenzustellen.

- Pay-Per-Use Economics: Anpassung der Kosten an den Wert mit nutzungsbasierter Inferenz und geplanten/getriggerten Umschulungszyklen.

- Schnell zur Einsicht: "Prädiktive Analytik als Dienstleistung" stellt Ihnen Pipelines, Funktionsspeicher und Notizbücher zur Verfügung und verkürzt so den Weg von der Frage zur Antwort.

- Elastische Skala: Für vierteljährliche Spitzenwerte aufbrausen, dann zurückfahren.

- Eingebaute Verlässlichkeit: SLAs für Verfügbarkeit, Latenz und Durchsatz, sowie verwaltete Upgrades und Patches.

AIaaS-Marktprognose

Bei den beiden Kurven handelt es sich um illustrative CAGR-Extrapolationen ausgehend von einer fiktiven Basis für 2025, um plausible Wachstumspfade aufzuzeigen, und nicht um eine einzige "wahre" Vorhersage. Im konservativen Fall wird von einer mittleren CAGR im Teenageralter ausgegangen, im aggressiven Fall von einer CAGR im hohen 20er-Bereich. Die Spanne spiegelt den Umfang, die Preisgestaltung, das Angebot und die regulatorischen Unsicherheiten wider, die die Ergebnisse erheblich beeinflussen können.

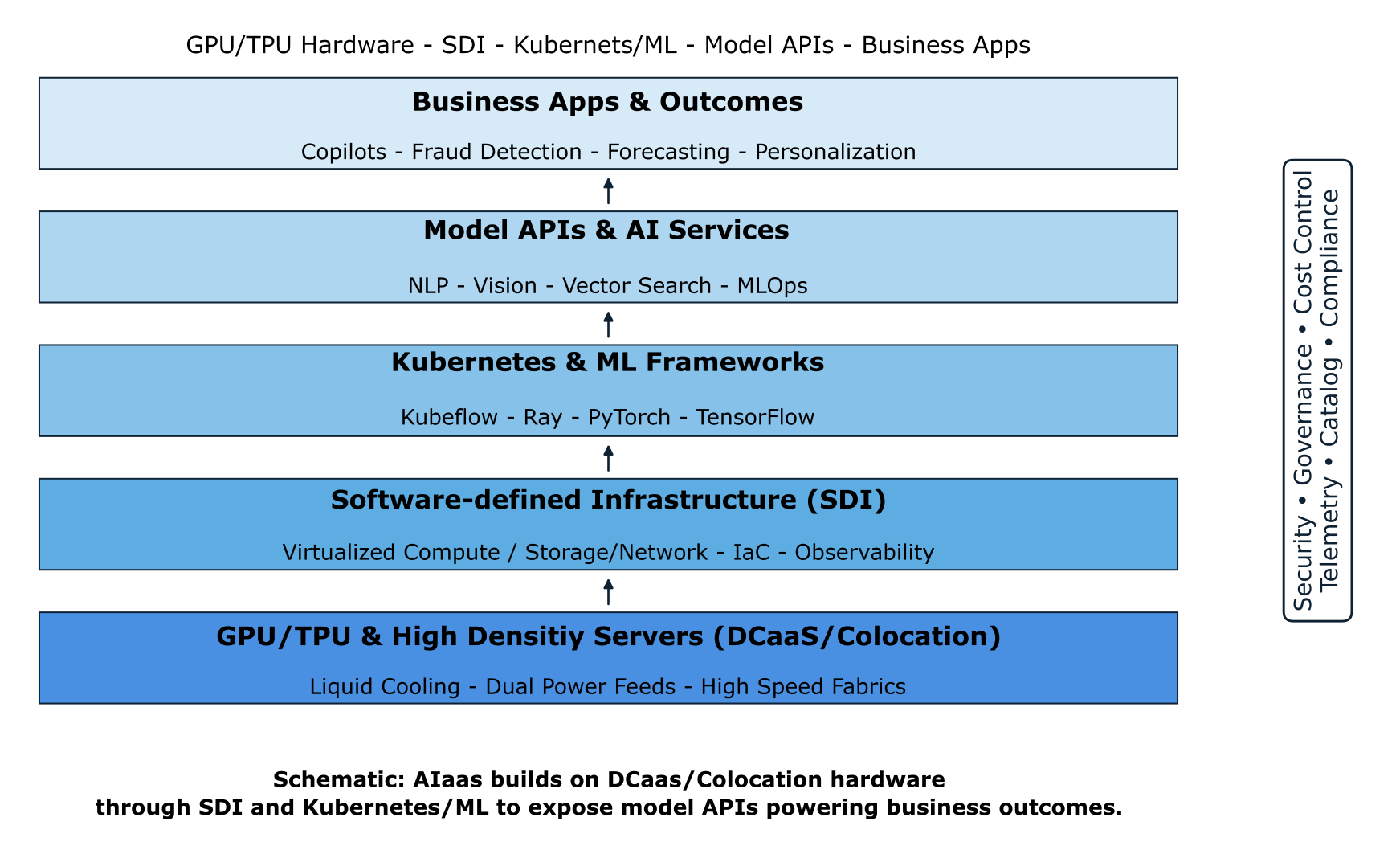

AIaaS Stack - Vom Rechenzentrum zu Geschäftsergebnissen

Künstliche Intelligenz als Service (Artificial Intelligence as a Service, AIaaS) ist kein einzelnes Produkt, sondern ein mehrschichtiges Ökosystem, das mit einer stabilen Rechenzentrumsinfrastruktur beginnt und in messbaren Geschäftsergebnissen gipfelt. Jede Schicht des Stacks trägt einen bestimmten Wert bei, ist aber auch von den darunter liegenden Grundlagen abhängig:

- GPU/TPU & High-Density-Server (DCaaS/Standort)

Die Grundlage von AIaaS ist eine rechenintensive Infrastruktur. Mit GPUs und TPUs ausgestattete Racks mit hoher Dichte werden in Colocation- oder DCaaS-Einrichtungen eingesetzt, die für Tier III- oder Tier IV-Zuverlässigkeit ausgelegt sind. CFD-Luftstrommodellierung, flüssigkeitsunterstützte Kühlung und doppelte Stromeinspeisung gewährleisten Leistung im großen Maßstab und halten PUE und WUE innerhalb der Nachhaltigkeitsziele. - Software-definierte Infrastruktur (SDI)

Über die Hardware hinaus abstrahiert SDI Rechen-, Speicher- und Netzwerkressourcen. Virtualisierungsplattformen und Infrastructure-as-Code (IaC)-Frameworks ermöglichen eine elastische Bereitstellung, dynamische Skalierung und präzise Beobachtung - der Schlüssel für KI-Workloads, die unvorhersehbare Spitzenwerte erreichen können. Die Integration mit DCIM- und SCADA-Systemen verbessert die Echtzeitüberwachung, Energieoptimierung und Fehlertoleranz. - Kubernetes & ML-Frameworks

KI-Workloads erfordern Orchestrierung. Verwaltete Kubernetes, Kubeflow, PyTorch, TensorFlow und verteilte Trainingsframeworks wie Ray ermöglichen es Unternehmen, Microservices, Modelltraining und Inferenzpipelines zuverlässig auszuführen. Colocation- und DCaaS-Anbieter liefern Fabrics mit niedriger Latenz und Interkonnektivität, die Ost-West-Verkehrsmuster in geclusterten GPU-Umgebungen unterstützen. - Modell-APIs & KI-Dienste

Wenn Infrastruktur und Orchestrierung vorhanden sind, stellen Anbieter APIs für die Verarbeitung natürlicher Sprache, Computer Vision, prädiktive Analysen und generative KI bereit. Diese APIs, die als Managed Services bereitgestellt werden, verwandeln KI von einer Forschungs- und Entwicklungsfunktion in einen operativen Geschäftsnutzen, der über sichere, verbrauchsbasierte Endpunkte zugänglich ist. - Geschäftsanwendungen und Ergebnisse

Die oberste Ebene ist der Bereich, in dem AIaaS einen greifbaren Wert darstellt. KI-Kopiloten, Betrugserkennung, Nachfrageprognosen und Smart-Vision-Systeme lassen sich in die Arbeitsabläufe von Unternehmen integrieren. Durch den Einsatz von Colocation-fähiger AIaaS können Unternehmen die Zeit bis zur Einsichtnahme verkürzen, die Investitionskosten senken, die Einhaltung von Vorschriften und Nachhaltigkeitsanforderungen gewährleisten und sich gleichzeitig vom Wettbewerb abheben.

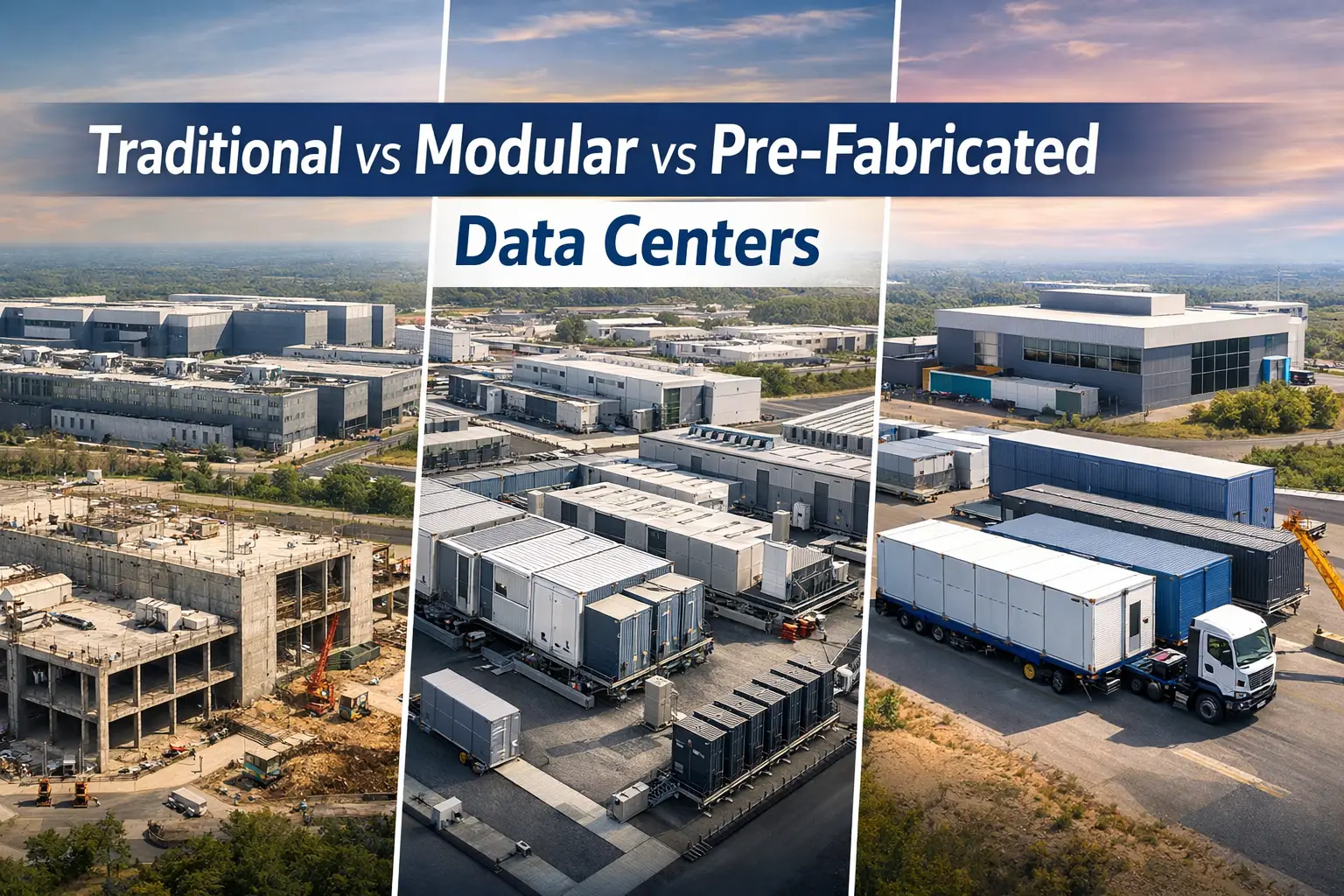

Infrastrukturanforderungen für AIaaS

Während AIaaS die Komplexität abstrahiert, hängen Leistung und Kosten immer noch von der Unterlage. Für ein durchgängig schnelles Training und eine Inferenz mit geringer Latenzzeit sind Sie hier richtig:

- Beschleunigtes Rechnen: Dichte GPU/TPU-Racks mit robuster Stromversorgung und Kühlung, idealerweise in Rechenzentren, die für hohe Verfügbarkeit und Energieeffizienz ausgelegt sind. Azura entwirft für KI-Workloads geeignete, auf Ebenen ausgerichtete, hochdichte Datenhallenlösungen, Stromverteilungs- und Ausfallsicherheitsarchitekturen.

- Kühlung in großem Maßstab: KI-Racks können herkömmliche Leistungsdichten übersteigen; zu den Optionen gehören eng gekoppelte Kühlung, Containment, flüssigkeitsunterstützte oder direkte Flüssigkeitskühlung sowie thermische Strategien auf Anlagenebene. Bei Projekten, die in die Infrastruktur des Campus oder der Stadt integriert sind, kann Fernkälte die Effizienz und die Betriebskosten weiter verbessern.

- Energiestrategie und Nachhaltigkeit: Stabile Einspeisung, Backup-Erzeugung und Möglichkeiten zur Einspeisung erneuerbarer Energien oder zur Kopplung mit Vor-Ort-Erzeugung und -Speicherung für mehr Ausfallsicherheit und geringere Emissionen. Azura unterstützt die Strom- und Energieplanung, einschließlich KWK/Tri-Gen-Konzepte und Wege zur Integration sauberer Energie.

- Leistungsstarker Speicher: NVMe und parallele Dateisysteme für das Training; Objektspeicher und Vektordatenbanken für Inferenz und abruferweiterte Generierung.

- Netzwerke mit niedriger Latenz: 25/100/200/400 GbE Ost-West-Fabrics und WAN-Backbones mit QoS. Für Edge AI und Mobilitätsanwendungen sind 5G-Design (einschließlich Slicing) und Glasfaser-/DWDM-Backhaul Schlüsselbereiche, in denen Azuras Telekommunikations-Engineering- und Netzwerkdesign-Services die Bereitstellung beschleunigen.

- Edge & Smart-City-Bereitschaft: Wenn Modelle in der Nähe von Sensoren und Bürgern laufen, kommt es auf den Standort und die Zusammenschaltung an. Azuras Expertise in Sachen Smart City und Rechenzentren hilft dabei, Rechenleistung dort zu platzieren, wo sie den größten Wert schafft - am Stadtrand, in der Metro oder im Zentrum.

- Standortauswahl und Durchführbarkeit: Bei der Neuentwicklung oder Erweiterung unterstützt die GIS-gestützte Analyse die Routenplanung, die Kartierung von Latenzzeiten und die Risikobewertung, um optimale Regionen und Verbindungen auszuwählen.

Datensicherheit und Governance

AIaaS verbindet vertraute Bedenken hinsichtlich der Datenverwaltung mit Modellrisiken und algorithmischer Verantwortlichkeit. Ein robustes Programm sollte abdecken:

- Datenresidenz und Souveränität: Halten Sie Schulungsdaten, -funktionen und -outputs innerhalb der erforderlichen Gerichtsbarkeiten; dokumentieren Sie grenzüberschreitende Transfers und Kontrollen. Azuras IKT- und Due-Diligence-Praktiken stimmen die Infrastruktur und die Richtlinien während der Planung und der Auswahl der Anbieter mit den rechtlichen Verpflichtungen ab.

- Verschlüsselung und Zugangskontrolle: Erzwingen Sie Verschlüsselung bei der Übertragung/im Ruhezustand, eine starke Identität für den API-Zugang, KMS/HSM-gestützte Schlüsselkontrolle und die Isolierung der Umgebung für sensible Arbeitslasten.

- Datenschutz durch Design: Minimieren Sie die Offenlegung von PII; wenden Sie Anonymisierung, Tokenisierung oder synthetische Daten an, wo dies möglich ist; führen Sie Prüfprotokolle.

- Verantwortliche AI & Compliance: Legen Sie Richtlinien für die Herkunft von Datensätzen, die Erklärbarkeit von Modellen, Bias-Tests und die Reaktion auf Vorfälle fest. Verwenden Sie eine änderungskontrollierte Promotion (dev→staging→prod) und dokumentieren Sie Modellkarten und die Datenherkunft für Audits. Das technische Due-Diligence-Rahmenwerk von Azura prüft diese Kontrollen mit Nachdruck, bevor Verpflichtungen eingegangen werden.

KI-Leistung mit Zuversicht freisetzen

Von GPU-fähigen Datenhallen bis zur KI-Integration in Unternehmen - Azura Consultancy entwickelt, validiert und liefert KIaaS-Strategien, die funktionieren.

Azura Consultancy's AIaaS-Strategie und -Einführung

Azura begleitet Sie von der Strategie bis zum stabilen Betrieb:

- Beratung & Architektur: Wir ordnen die Geschäftsziele den KIaaS-Funktionen zu, wählen Anbieter aus und entwerfen Referenzarchitekturen, die sich in Ihre Netzwerke, Identitäts- und Datenbestände integrieren lassen - auf der Grundlage von ICT-Planung und Machbarkeit.

- Data Center Design für AI: Von hochdichten Rack-Layouts und elektrischen Einzelleitungen bis hin zu Uptime-Tier-Pfaden und CFD-gesteuertem Wärmedesign für KI-White Spaces - unsere Ingenieure passen die Einrichtungen an die GPU/TPU-Workloads an.

- Strategie für Energie und Kühlung: Wir stimmen KI-Wachstumspläne mit der Versorgungskapazität, der Stromerzeugung/Speicherung vor Ort und skalierbaren Kühlsystemen ab - gegebenenfalls auch mit Lösungen auf Bezirksebene.

- Netzbetreiber- und Cloud-Verbindungen: Wir entwickeln 5G-, optische/DWDM- und Backbone-Verbindungen, um Modelle näher an Benutzer und Daten heranzubringen und so Latenzzeiten und Egress-Kosten zu reduzieren.

- Programm- und Änderungsmanagement: Strukturierte Governance-, Risiko- und Qualitätskontrollen sorgen dafür, dass Ihr Programm im Zeit- und Budgetrahmen bleibt - unterstützt durch die Projektmanagement-Methodik von Azura.

- Sorgfaltspflicht und Beschaffung: Unabhängige technische Due-Diligence-Prüfungen und LTA-ähnliche Überprüfungen verringern das Risiko der Anbieterauswahl, der SLAs und der Nachhaltigkeitsansprüche vor der Auftragsvergabe.

- Smart-City- und Edge-Integration: Für städtische Behörden und Betreiber verbinden wir AIaaS mit intelligenten Infrastrukturprogrammen - wir entwerfen 5G/RAN, Kernnetze und Datenknotenpunkte, die KI in großem Umfang sicher einsetzen.

Links zu verwandten Artikeln:

Siehe auch: Colocation-Rechenzentren, Edge Data Centers, Rechenzentrum als Dienstleistung (DCaaS).

Verwandte Azura-Seiten, die Ihre AIaaS-Reise unterstützen: Technische Lösungen für Rechenzentren (Entwurf und Zertifizierung), Technische Due Diligence (Risiko und Bereitschaft), Projektleitung (Steuerung der Lieferung), Entwurfsdienste für Telekommunikationsnetze (5G/Glasfaser-Backbones), und Lösungen für die Fernkühlung (Wärmestrategie mit hoher Dichte).

Warum das jetzt wichtig ist

AIaaS verwandelt KI von einem mehrjährigen Investitionsprogramm in einen Service, den Sie einschalten, integrieren und skalieren können. Mit der richtigen Grundlage - auf KI ausgelegte Einrichtungen, belastbare Strom- und Kühlsysteme, Netzwerke mit geringer Latenz und geprüfte Governance - können Unternehmen mit Zuversicht, Schnelligkeit und messbarem ROI von der Pilotphase zur Produktion übergehen. Azura bringt diese Bausteine zusammen.